Rövid válasz: 2026-ban a négy nagy hyperscaler (Amazon, Meta, Microsoft, Alphabet) 527–700 milliárd dollárt költ AI infrastruktúrára a Goldman Sachs becslése szerint. Az AWS AI bevétele 15 milliárd dollár (2026 Q1), a Meta 35 milliárd dolláros CoreWeave-elkötelezettséget tett. A magyar KKV-knak ez olcsóbb cloud AI szolgáltatásokat, de szigorúbb kapacitás-előrendelést és EU adatszuverenitási döntést hoz 2026–2027-ben.

Egy átlagos magyar vállalkozó valószínűleg nem olvasta végig Andy Jassy 2025-ös Amazon részvényes levelét, amit április 10-én publikáltak. Én viszont elolvastam — és néhány szám úgy kiugrott belőle, hogy muszáj volt leülni. Az AWS AI bevétele három év alatt 260-szor nagyobb, mint amit maga az AWS produkált az indulásának első három évében. És ez csak az egyik az előző héten landolt, egymást erősítő bejelentésekből.

A másik: a Meta április 9-én további 21 milliárd dollárt igért a CoreWeave-nek GPU kapacitásra, ami a már futó szerződéssel együtt 35 milliárd dolláros elkötelezettséget jelent 2027–2032-re. A harmadik: a Goldman Sachs friss előrejelzése szerint a globális hyperscaler capex 2026-ban 527 és 700 milliárd dollár között lesz — nagy részben AI-ra.

Ha ezeket a számokat együtt nézed, egy dolog világos: a cloud AI már nem spekuláció, és nem is drága proof of concept. A magyar KKV-knak konkrét döntéseket kell hozniuk a következő 12 hónapban. Ez a cikk megmutatja, melyeket.

Mi az a hyperscaler és miért változott meg 2026-ra?

A „hyperscaler" egy konkrét technológiai kategória: olyan cloud szolgáltatók, amelyek százezres vagy milliós szerverállományt tartanak fenn, és egyetlen platformról szolgálnak ki globális ügyfélkört. A klasszikus hármas: Amazon Web Services (AWS), Microsoft Azure és Google Cloud. Néhány éve a Meta és az Alibaba Cloud is ide számít. 2026-ra pedig a CoreWeave is belépett a körbe — csak nem klasszikus hyperscaler módon, hanem kizárólag AI workload-okra optimalizálva.

Ami 2026-ban megváltozott: a verseny fókusza átbillent a modellképzésről a production inference-re. Az elmúlt két évben mindenki a „melyik nagyobb modellt tudunk betanítani" kérdésre hajtott — 2026-ra viszont a valódi üzleti termék a már betanított modellek masszív skálázású futtatása milliárd felhasználó előtt. Az inference más hardvert, más hálózatot és más költségstruktúrát igényel, mint a training. Ez a szemléletváltás magyarázza a most aláírt hosszú távú szerződéseket.

Másképp fogalmazva: a modellpályázat helyett elkezdődött az infrastruktúra-pályázat. Aki ma lefoglalja a GPU-kapacitást 2027-re, az lesz képes jövőre olcsón kiszolgálni a felhasználókat. Aki nem foglal, az „on demand" kapacitáshiányba fog futni. A MI stratégia vállalkozásoknak 2026-ban cikkünkben részletesebben elemeztük, miért nem halasztható tovább ez a döntés.

A 700 milliárd dolláros verseny: 3 bejelentés, ami 2026 áprilisát átírta

Nem mindennap landol három ilyen adat egy héten belül. Mindhárom nemzetközi üzleti médiában (Bloomberg, TechCrunch, The Verge) főcím volt, és mindhárom ugyanarra mutat: a cloud AI infrastruktúra lett a következő évtized legnagyobb tőkeberuházási projektje.

AWS AI — 15 milliárd dollár bevétel, 260x-os növekedés

Andy Jassy, az Amazon vezérigazgatója az április 10-i részvényes levélben megerősítette, hogy az AWS AI üzletág bevétel futamideje 2026 első negyedévében meghaladta a 15 milliárd dollárt (Amazon 2025 Annual Shareholder Letter, 2026. április 10.). Az „AWS AI" itt minden olyan szolgáltatást takar, amiben mesterséges intelligencia a központi érték: Bedrock (modell marketplace), SageMaker (tréning és deployment), valamint az Amazon saját AWS Trainium és Graviton chipjei körüli ügyféléletciklus.

„Három évvel az AWS kereskedelmi indítása után a bevétel futamidő 58 millió dollár volt. Három évvel az AI-hullám elindítása után az AWS AI bevétel futamideje meghaladja a 15 milliárd dollárt 2026 Q1-ben — közel 260-szor nagyobb, mint az AWS ugyanebben az időszakban — és gyorsan növekszik tovább."

— Andy Jassy, Amazon CEO, 2025-ös éves részvényes levél, 2026. április 10.

A levélben Jassy azt is megerősítette, hogy az AWS custom silicon business (Trainium + Graviton + Nitro) éves futamideje 20 milliárd dollárra duplázódott. A Trainium2 chipek — amelyek a dokumentum szerint 30 százalékkal jobb ár-teljesítmény arányt adnak, mint a hasonló kategóriájú NVIDIA GPU-k — „largely sold out" státuszban vannak. A 2026 elején indult Trainium3 szintén szinte teljesen lefoglalt. Forrás: TechWireAsia elemzés és Amazon hivatalos részvényes levél.

Meta-CoreWeave 21 milliárd dolláros deal

Április 9-én a CoreWeave bejelentette, hogy a Meta 21 milliárd dollár értékben kiterjesztette a már futó kapacitás-szerződést. A 2027–2032 időszakra szóló kiterjesztést az előzetes 14,2 milliárd dolláros megállapodáshoz adva a Meta teljes CoreWeave commitment-je kb. 35 milliárd dollár. A deal célja: az NVIDIA Vera Rubin (R100 és R200 kódnevű) platform első generációs deploymentje inference workload-okra. Ez a Vera Rubin az NVIDIA GTC 2026-on bemutatott új generációs AI chip-architektúra.

A CoreWeave 2024-ben még relatív újonc volt — 2026-ra viszont a Meta dealt megelőzően is 66 milliárd dollár értékű backlogot halmozott fel, és a 2025-ös bevételük 5,13 milliárd dollár volt, 168%-os éves növekedéssel (CoreWeave FY2025 earnings report, 2026. március). Mindez egyetlen okból: a CoreWeave nem egy generalista cloud, hanem kifejezetten százezres GPU-klaszterekre optimalizált AI-native operátor. Michael Intrator, a CoreWeave CEO-ja a bejelentésben mindezt kompakt módon foglalta össze:

„Ez újabb példa arra, hogy a vezető cégek a CoreWeave AI cloud-ját választják a legigényesebb workloadjaikhoz."

— Michael Intrator, CoreWeave CEO, 2026. április 9.

Részletes üzleti elemzés a dealről: Investing.com — Meta hands CoreWeave $21B.

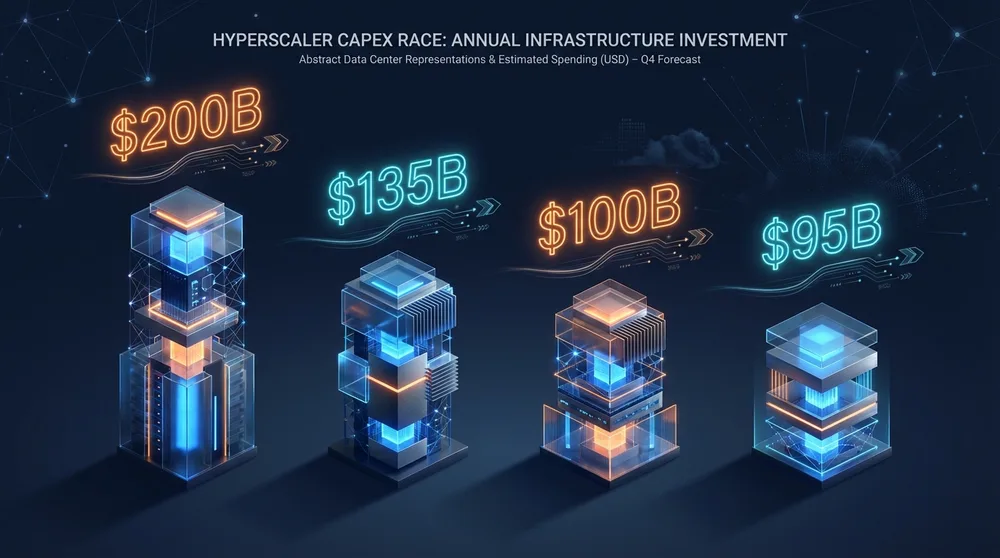

Goldman Sachs: 700 milliárd dollár globális hyperscaler capex

Ha csak az AWS és a Meta számát néznéd, a kép már így is nagy. A Goldman Sachs 2026-os forecast-ja viszont ezen is túllép: a négy nagy hyperscaler (Amazon, Meta, Microsoft, Alphabet) együttes capex-ét 527–700 milliárd dollár közé teszi 2026-ra (Goldman Sachs 2026 hyperscaler capex forecast). Az Amazon önmagában 200 milliárd dolláros capex-e magasabb, mint amit bármelyik másik technológiai cég valaha elköltött egyetlen évben. A hyperscaler capex-növekedés háttereit Andy Jassy így összegezte:

„Nem találomra fektetünk körülbelül 200 milliárd dollárt capex-be 2026-ban. Az OpenAI legutóbbi, 100 milliárd dollárt meghaladó kötelezettsége jó példa arra, miért."

— Andy Jassy, Amazon CEO, 2025-ös éves részvényes levél

A capex mögött tehát már nem hitrendszerből finanszírozott spekuláció áll, hanem aláírt long-term enterprise szerződések. Az OpenAI önmagában 100 milliárd dollár feletti kapacitást kötött le az AWS-nél, és az OpenAI idei IPO-jának floor valuation-je 852 milliárd dollár. Az OpenAI GPT-5.4 elemzésünkben részletesen is kibontottuk, mit jelent ez a termékoldalon. A piac realizálta, hogy az ai capex 2026 már nem opció, hanem kötelező stratégiai tengely.

Mit jelent ez a magyar KKV-knak?

Egy átlagos magyar vállalkozó jogosan kérdezheti: mi közöm ehhez? A szám annyira nagy, hogy szinte absztrakt. Pedig négy konkrét hatása van a magyar piacra, és mindegyik a következő 12 hónapban érkezik.

1. Olcsóbb cloud AI — már nem drága POC

Három évvel ezelőtt egy magyar KKV számára egy komolyabb AI integráció saját infrastruktúrán gyakorlatilag nem volt megfizethető. Egy NVIDIA H100 GPU-kártya listaára 30–40 ezer dollár (az „nvidia h100 ár" keresésre havi mérhető volumen van a Google-ön), és önmagában nem csinál semmit — kell hozzá szerver, hálózat, hűtés, üzemeltetés. A valós árat így gyakorlatilag senki nem fizeti ki magának.

A cloud AI viszont fordítva működik: az infrastruktúrát a hyperscaler kiépíti, te pedig percdíjas alapon veszed igénybe. Az AWS AI 15 milliárd dolláros bevétele pontosan ezért nőtt ilyen gyorsan — a belépési küszöb 0 dollárra csökkent. A magyar KKV számára ez azt jelenti, hogy a Bedrock, Google Cloud AI, vagy Microsoft Azure AI portfóliókból lényegében bármelyik alkalmas kiindulásnak, és egy korai projekt havi költsége 50–500 ezer forint körül realizálható az első hat hónapban — jellemzően kevesebb, mint egyetlen junior fejlesztő bére.

A saját tapasztalatunk megerősíti ezt a számot: a SocialPro által 2025–2026-ban kísért magyar KKV cloud AI projekteknél az első hat hónapos tényleges havi költség jellemzően 80–320 ezer forint között alakult — ezen belül a Bedrock + Claude Sonnet alapú ügyfélszolgálati agent és a dokumentum-összefoglaló volt a két legolcsóbb belépési pont. A havi számla a hetedik hónaptól kezd érdemben nőni, amikor a modell bekerül a production workflow-ba és a hívásszám skálázódik.

2. Kapacitás szűkösség — itt az ideje proaktív szerződést kötni

A jó hír, hogy a cloud AI olcsó. A rossz hír, hogy az on-demand kapacitás zsugorodik. Amikor a Meta, az OpenAI és a Microsoft hosszú távú szerződésekkel köti le az NVIDIA Vera Rubin flotta java részét, a „reserve instances" és „committed use discounts" fontosabbak lesznek, mint valaha. Egy magyar KKV, aki ma pay-as-you-go módon dolgozik, 2027-ben váratlan árrobbanásra és késleltetett allokációra futhat rá a legforgalmasabb régiókban.

Konkrét tanács: ha már fél éve stabilan használsz cloud AI szolgáltatást (inference vagy training), érdemes megnézni az adott szolgáltató egyéves committed use discount-ját. Jellemzően 25–40 százalékot lehet spórolni, és garantált kapacitást kapsz cserébe. Ez nem eladósodás — ez piacbiztosítás.

3. EU adatszuverenitás — a dilemma nem szűnik meg

A három nagy hyperscaler amerikai. A Meta és a CoreWeave is. Ha egy magyar KKV ügyféladatokat (GDPR alá tartozó személyes adatokat) küld egy ilyen szolgáltatásnak inference-re, akkor az EU AI Act és a Schrems II utáni adatvédelmi keret alá esik. A GAIA-X európai cloud kezdeményezés 2026-ra sem lett olyan reális alternatíva, hogy kapacitásban a hyperscalerekkel versenyezzen — a kapacitáskülönbség két nagyságrendnyi.

A gyakorlatban három út létezik: (1) EU-s régióban futtatni a cloud AI workload-ot az amerikai szolgáltatónál (AWS Frankfurt, Azure West Europe, Google europe-west4) és Data Processing Agreement-et kötni; (2) európai specialista szolgáltatót használni (Hetzner, OVHcloud, T-Systems) ott, ahol a modell és a latency engedi; (3) érzékeny adatoknál lokális, nyílt forrású modellt futtatni saját szerveren. A három út keverhető, és a legtöbb magyar KKV-nak a vegyes modell lesz a reális.

4. Energia és hazai adatközpontok

A Bloom Energy 2026-os Data Center Power Report szerint a globális adatközpontok már az összes áramfogyasztás 1,5 százalékát teszik ki, évi körülbelül 600 TWh mennyiséggel (Bloom Energy 2026 Data Center Power Report). Ez a szám 2027-re várhatóan nagyobb lesz, mint sok fejlődő ország teljes éves áramfogyasztása. A beruházási verseny egyik szűk keresztmetszete 2026-ra már nem a chip, hanem az áram és a hűtés.

Magyarország földrajzi és energetikai pozíciója (viszonylag alacsony ipari áramár, Paks II építése, jó hálózati csatlakozás Nyugat-Európa és Balkán között) elviekben lehetővé tenne egy regionális AI adatközpont-szerepet. A gyakorlat ettől még messze van: a jelenlegi hazai kapacitás a hyperscaler skálához képest elenyésző. Egy magyar KKV számára mindez közvetetten számít — a hazai adatközpont-fejlesztés lassan, de stabilan növeli az EU-régiós alternatívákat.

Mennyit költenek a hyperscalerek 2026-ban? (capex táblázat)

Az alábbi tábla összefoglalja, melyik nagy technológiai cég mennyi pénzt költ 2026-ban AI infrastruktúrára. Az adatok a vállalatok saját bejelentéseiből, a Goldman Sachs kutatásából és a Bloomberg konszenzusból származnak. A „döntően AI" oszlop azt jelzi, hogy a teljes capex nagy része közvetlenül AI training, inference vagy kapcsolódó adatközpont-bővítés.

| Vállalat | 2026 teljes capex | Döntően AI-ra | Megjegyzés |

|---|---|---|---|

| Amazon | ~200 milliárd USD | igen | AWS AI bevétel futamidő: 15 mrd USD (Q1 2026) |

| Meta | 115–135 milliárd USD | igen | CoreWeave commitment: 35 mrd USD (2027–2032) |

| Microsoft | 100+ milliárd USD | igen | OpenAI és Azure AI fókusz |

| Alphabet (Google) | 95+ milliárd USD | igen | Google Cloud AI és TPU flotta |

| Globális hyperscaler összesen | 527–700 milliárd USD | többsége | Goldman Sachs 2026 forecast |

Egy szám a táblából: 527 milliárd dollár Magyarország éves GDP-jének (kb. 200 milliárd USD) 2,6-szorosa. Egyetlen év, egy szektor, négy cég.

Mit tegyen most egy magyar vállalkozó?

A stratégia nem az, hogy szóról szóra másolj egy Meta vagy Amazon méretű döntést. A stratégia az, hogy a megfelelő méretben hozd meg a saját döntéseidet, és ne hagyd ki a cloud AI következő 12 hónapját. Öt konkrét lépés, amit érdemes megtenni.

- Auditáld a cloud számládat. Nézd meg, mennyit költesz jelenleg bármelyik hyperscaler szolgáltatásra (AWS, Azure, Google Cloud), és abból mennyi megy inference-re vagy AI modellhívásra. Ha a havi cloud költséged 500 ezer forint felett van, és még semmi sem AI — stratégiai lemaradásban vagy.

- Válassz egy cloud AI platformot és fókuszálj rá. A választás sorrendje általában: AWS Bedrock (ha AWS-ben már dolgozol), Google Cloud AI (Gemini integráció), Microsoft Azure AI (Microsoft 365 ökoszisztémában). Többet elveszítesz azzal, ha mindhármat egyszerre tanulod, mint amit nyersz a diverzifikációval.

- Kösd le a kapacitást egy évre előre. A committed use discount jellemzően 25–40 százalékos megtakarítást ad, és garantált kapacitást. A 2027-es kapacitás-szűkösségből lesznek nyertesek és vesztesek — te legyél a nyertesek között.

- Készíts data residency döntési mátrixot. Az első kérdés minden adatra: GDPR-érintett, ügyfél-azonosítható? Ha igen, kötelezően EU régióba. Ha nem, mehet amerikai adatközpontba, és lényegesen olcsóbban fog futni. Egy egyszerű Excel is elég ehhez.

- Legyen fallback-ed nyílt forrású modellre. Az Anthropic, OpenAI és Google API-k önmagukban megbízhatóak, de a SaaS-rendszered egyetlen ponton sem függhet kizárólag egy külső API-tól. Legyen legalább egy lokálisan futtatható Llama- vagy Gemma-alapú backup, amit szükség esetén aktiválni tudsz. A KKV automatizációs toplistánk is ebbe az irányba mutat.

Gyakori kérdések (FAQ)

Mi az a hyperscaler?

Olyan cloud szolgáltató, amely százezres vagy milliós méretű szerverinfrastruktúrát üzemeltet, és egyetlen platformon keresztül szolgál ki globális ügyfélkört. A fő szereplők: Amazon Web Services (AWS), Microsoft Azure, Google Cloud, Meta és Alibaba Cloud. 2026-ban a CoreWeave is ide sorolandó — bár kifejezetten AI workload-okra specializálódott.

Mennyibe kerül a cloud AI egy magyar KKV-nak?

A tipikus belépési költség kisebb projekteknél havi 50–500 ezer forint között van, ami inference (pl. ügyfélszolgálati chatbot, dokumentum feldolgozás, tartalomgenerálás) és tárolás között oszlik meg. Ez az összeg jellemzően alacsonyabb, mint egyetlen junior fejlesztő bére — és skálázással növelhető. Az AWS Bedrock, Google Cloud AI, Microsoft Azure AI és Anthropic közvetlen API között a különbségek projekt-specifikusak.

Miért nem érheti el egy magyar cég közvetlenül az NVIDIA H100-at?

Elérheti — csak gyakorlatilag nincs értelme. Egy NVIDIA H100 kártya listaára 30–40 ezer dollár, és egyedül nem működik: kell hozzá szerver, hálózat, hűtés, redundancia, üzemeltető. A teljes stack egy KKV-méretű projekthez 1,5–3 év alatt térül meg, miközben a cloud AI azonnal elérhető, pay-as-you-go módon. A saját GPU-flotta csak akkor észszerű, ha nagy volumenű, folyamatos workload van és adat-érzékenységi okokból nem lehet cloudban futtatni.

Milyen európai alternatívák vannak az AWS, Azure és Google Cloud helyett?

Három komolyabb kategória: (1) európai specialista IaaS szolgáltatók — Hetzner (Németország), OVHcloud (Franciaország), Scaleway, IONOS; (2) integrátorok — T-Systems, Atos; (3) regionális AI-specialista operátorok — pl. Nscale (UK). Ezek a CoreWeave méretét nem érik el, de érzékeny adatokra, GDPR-első döntéshozatalra és egyszerűbb compliance-re jó választások. Egy KKV jellemzően vegyes stratégiával dolgozik: inference AWS-en vagy Azure-on, adat-tárolás európai szolgáltatónál.

Hogyan érinti az EU AI Act a cloud AI használatot?

Az EU AI Act 2025-ben lépett hatályba, és kötelező kockázat-alapú besorolást ír elő bizonyos AI rendszerekre. A cloud AI szolgáltatók (AWS, Azure, Google Cloud) a saját compliance-jüket garantálják, de a felhasználó felelőssége marad, hogy a saját use case-e melyik kategóriába esik és milyen dokumentációs kötelezettség van. A részleteket a külön EU AI Act magyar KKV-knak cikkünkben bontottuk ki.

Kiemelt források

A cikk 2026. április 11-én készült. Az alábbi források szolgálták az alapadatokat — kifejezetten javaslom, hogy az eredeti angol anyagokat is nézd át, mert a technikai részletek gyorsan változnak:

- Amazon 2025 Annual Shareholder Letter (Andy Jassy, 2026.04.10)

- TechWireAsia — AWS AI bevétel elemzés

- Investing.com — Meta $21B CoreWeave deal

- CoreWeave hivatalos sajtóközlemények

- Bloom Energy — 2026 Data Center Power Report

- NVIDIA GTC 2026 (Vera Rubin bejelentés)

- European Commission — Digital Strategy / GAIA-X

A 2026-os cloud AI piac néhány hétes ritmusban változik. Ha stratégiai döntés előtt állsz — cloud platform váltás, AI integráció, data residency keret — érdemes lehet egy konzultáción átnézni, hogy a saját cégedre hogyan vonatkozik mindez. A SocialPro ingyenes konzultációján konkrét cloud AI roadmap-et készítünk KKV méretre.