Az Anthropic Claude Cowork és Conway a 2026 Q1-ben bemutatott always-on agent paradigma két kulcseleme: a Conway egy háttérben futó, webhookokra reagáló perzisztens ágens (nem chatbot), a Cowork pedig több agent egyidejű együttműködését teszi lehetővé egy közös workspace-en. Az Anthropic 30 milliárd dolláros ARR-rel 2026 Q1-ben meghaladta az OpenAI enterprise bevételét, és a Claude Opus 4.6 mostantól 1 millió token kontextust kezel egyetlen beszélgetésben. Magyar KKV-knak ez azt jelenti: az addig fejlesztőcsapatot igénylő workflow-automatizáció Claude Pro (~20 USD/hó/fő) előfizetésről elindítható, EU AI Act- és GDPR-kompatibilis módon.

Kulcsszámok egy pillantásra (2026 Q1)

- 30+ új funkció az Anthropic 2026 Q1-es bejelentésében (forrás: aimaker.substack.com összefoglaló)

- 30 milliárd USD ARR — az Anthropic meghaladta az OpenAI enterprise bevételét (Anthropic Q1 2026)

- 1000+ ügyfél költ évi 1 millió USD feletti összeget Claude-ra

- 1 millió token kontextus — Claude Opus 4.6 és Sonnet 4.6 egyaránt

- 40% — a vállalati alkalmazások aránya, amelyekben 2026 végére lesz AI-agent (Gartner 2026 előrejelzés)

- 23% — a vállalatok aránya, amelyek már skálázzák az AI-ágenseket (Gartner 2026)

- 24,69% — átlagos produktivitásnövekedés agentic AI bevezetés után (piaci benchmark, 2026)

- 20 óra/hét — megtakarítás felhasználónként a Salesforce Slackbot belső bevezetése után (Salesforce 2026. január)

- 96% — felhasználói elégedettség 85 000+ Salesforce alkalmazott körében (Slackbot belső teszt)

Ez az elemzés 2026. április 10-én készült. Szerző: Krasznai Gábor, SocialPro alapító, KG Creative Media Group Kft. ügyvezetője — 2016 óta foglalkozik digitális marketinggel és AI-integrációval magyar KKV-knak. A cikk az Anthropic 2026 Q1-es fejlesztői és enterprise frissítéseit dolgozza fel, különös tekintettel a Claude Cowork és Conway funkciókra, valamint ezek magyar vonatkozásaira.

Amikor 2024-ben először használtam egy Claude modellt egy ügyfélprojekten, még "okos autocomplete-ként" gondoltam rá. Két évvel később ugyanez a rendszer önállóan fut a háttérben, maga indít workflow-kat, kódot ír, felülvizsgálja a saját munkáját, és csak akkor szól, ha döntést kell hoznom. A 2026 Q1 azért lett mérföldkő, mert az Anthropic kimondta, amit addig csak sejtettünk: a chat-felület elfogyott, jön az always-on agent paradigma.

Ha vállalkozóként vagy marketingesként most próbálod megérteni, miért beszél mindenki Claude Conway-ről és Cowork-ről, és miért vett fel az Anthropic szinte hirtelen 30 milliárd dolláros ARR-t — ez a cikk rendet rak a képben. Bemutatom, mi a két új funkció, miben más ez, mint egy chatbot, és mit kezdhet vele egy magyar KKV a 2026-os EU AI Act árnyékában.

Fontos elhatárolás: míg a pár nappal korábbi Claude Mythos Preview az Anthropic speciális, zárt körű AI kiberbiztonsági modellje (Project Glasswing), a Cowork és Conway ezzel szemben az általános enterprise munkafolyamatokra épülő, szélesebb körben elérhető fejlesztés. A két hír ugyanarra a hétre esik, de teljesen más célközönségnek szól.

Mi az a Claude Conway és Cowork?

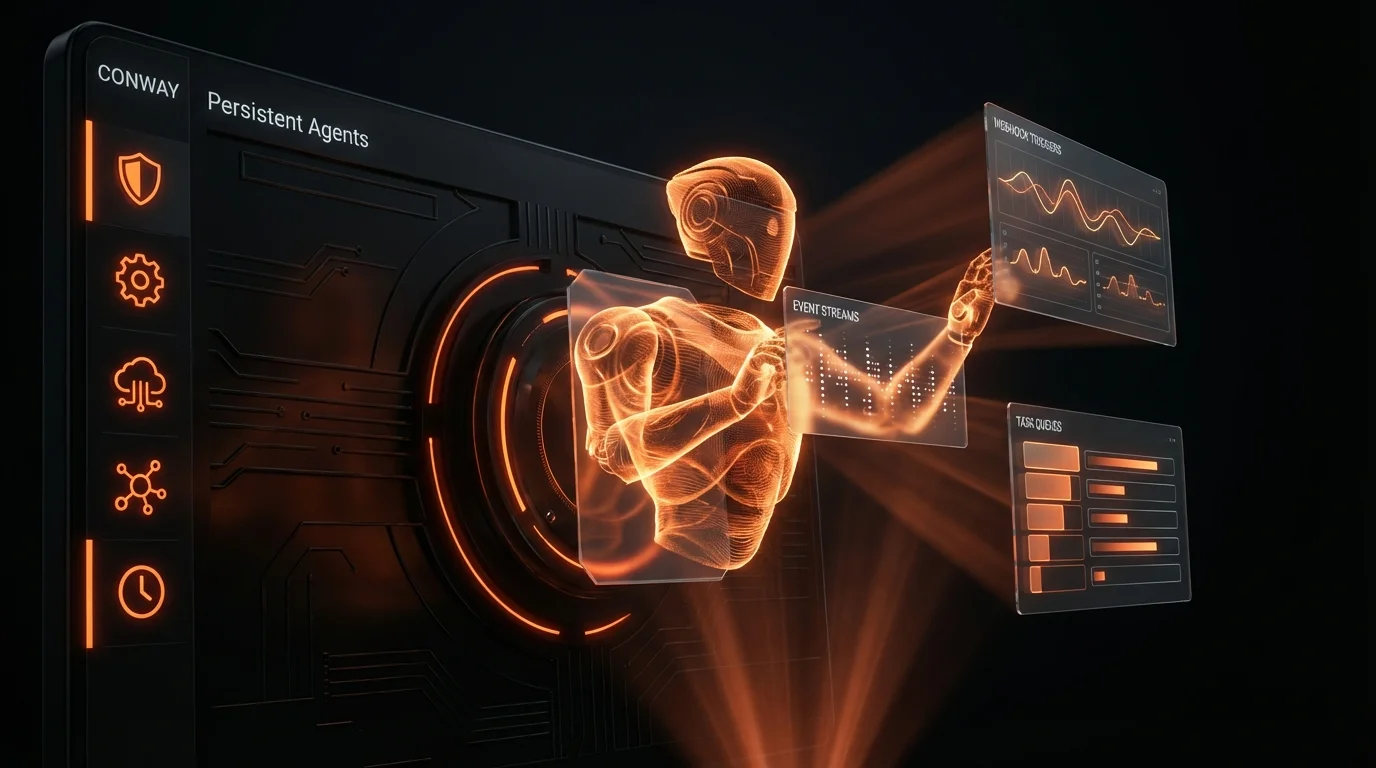

Kezdjük a fontossal: a Conway nem egy új Claude modell. Ez egy környezet — egy keret, amiben a Claude másképp él, mint egy chatablakban. Az AI Revolution YouTube-csatorna összefoglalójában így fogalmazták meg:

"Conway looks less like a chatbot and more like a persistent agent environment. Instead of opening a normal chat, Conway shows up as its own sidebar option. It's built to sit there in the background, get triggered by events and start working. That's basically an always-on agent model."

Magyarul: "A Conway kevésbé egy chatbot, inkább egy perzisztens ágenskörnyezet. Ahelyett, hogy egy normál chat nyílna meg, a Conway saját sidebar opcióként jelenik meg. Úgy van felépítve, hogy a háttérben marad, eseményekre reagál és elkezd dolgozni. Ez lényegében egy mindig-on agent modell."

Ha eddig úgy dolgoztál Claude-dal, hogy megnyitottad a böngészőt, beírtad a kérdést és megkaptad a választ — a Conway után olyan, mintha a modell mellé ültettek volna egy kolléga-asszisztenst, aki nem alszik, nem felejt, és nem kell neki minden reggel elmondani, mi a feladat.

A Cowork ennek a párja a másik oldalon: ez az a felület, ahol több agent egyszerre dolgozik ugyanabban a munkakörnyezetben. Egy fejlesztői workflow-ban ez konkrétan azt jelenti, hogy az egyik agent kódot ír, a másik code review-t futtat rá, a harmadik tesztet generál, és mindezt egy közös állapottéren, nem három különálló chatben. A Cowork integrálódik a meglévő dev toolchain-be — VS Code, terminál, git — szóval nem kell új IDE-t tanulnod hozzá.

Miért új ez? Hiszen már volt agent-mód

Jogos kérdés. Volt tool use, volt artifact, volt Claude Code CLI is. De ezek mind reaktívak maradtak: te nyitottad meg a session-t, te adtad a promptot, te zártad le. A Conway egy fontos dologban más: webhookokon keresztül külső események triggerelik. Egy új GitHub issue, egy beérkező email, egy Stripe esemény, egy Supabase insert — mindegyik elindíthat egy Conway-futást anélkül, hogy te a közelben lennél. Chrome browser integrációval pedig közvetlenül a böngésződben tud működni: megnyit egy oldalt, olvas, dönt, kattint.

Hogyan működik az always-on agent paradigma?

Az "always-on" szó itt nem marketing — szó szerint értendő. A klasszikus chatbot-modellben az AI egy kérésre egy választ ad, majd elfelejti, amit beszéltetek (hacsak nem táplálod vissza a kontextusba). A perzisztens ágens ezzel szemben folyamatosan fut, állapotot tart, és proaktívan cselekszik.

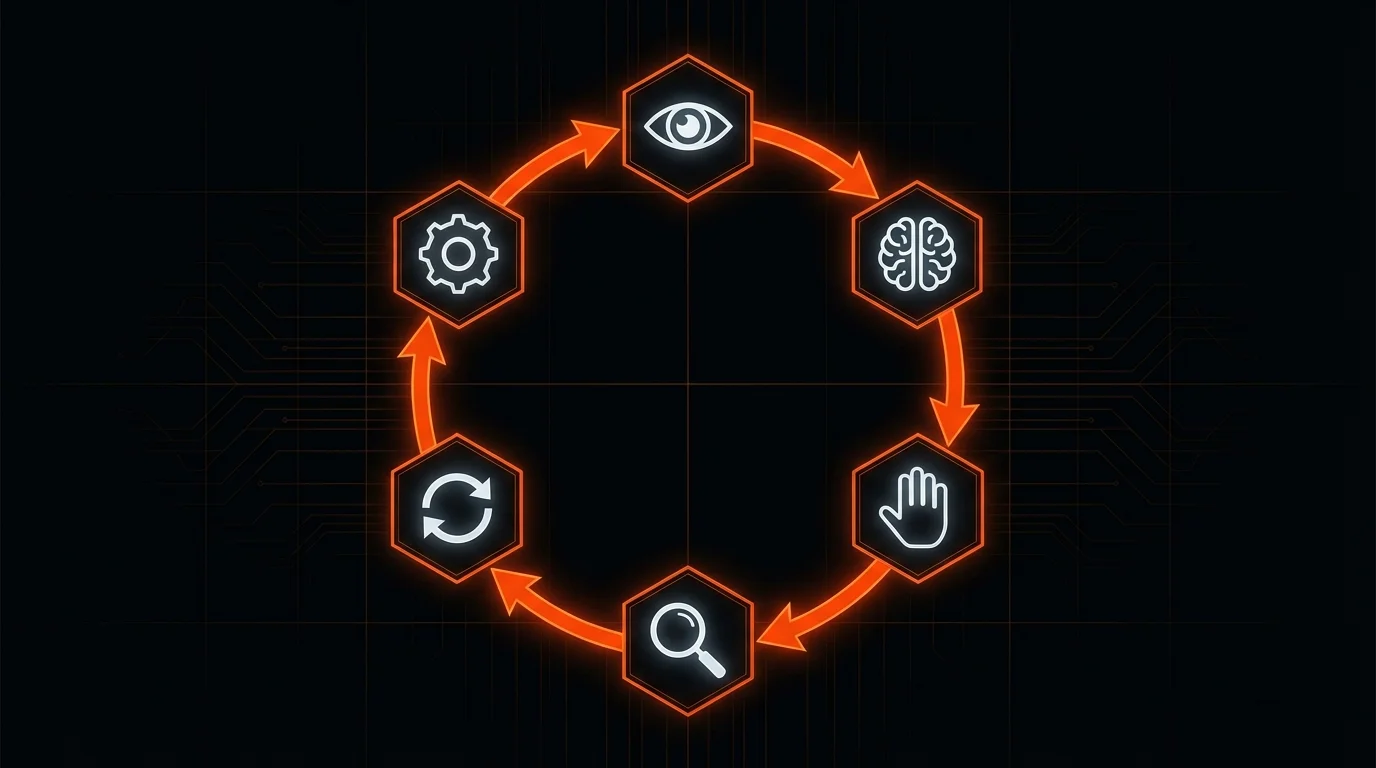

A különbséget három rétegben érdemes nézni:

- Időbeliség: a chatbot reaktív (kérdezz, válaszol), az agent proaktív (figyel, reagál, kezdeményez)

- Memória: a chatbot session-szintű, az agent hosszú távú, perzisztens állapottal dolgozik

- Végrehajtás: a chatbot válaszol, az agent cselekszik — akár ember nélkül is, többlépéses tervek alapján

A háttérben egy agent loop fut: észlelés → tervezés → cselekvés → megfigyelés → korrekció. Ezt a ciklust az Anthropic saját mérnöki blogján is részletesen leírta a multi-agent research system cikkében: egy "vezető" agent szétbontja a feladatot, alügynököket indít, majd összegzi az eredményeket. A Conway ezt a logikát viszi át produktivitási kontextusba. Ha bővebben érdekel a két fogalom közti határ, érdemes elolvasnod az AI agent vs chatbot cikkünket.

Chatbot vs Agent vs Conway — összehasonlító táblázat

| Tulajdonság | Chatbot | Agent (klasszikus) | Conway (always-on) |

|---|---|---|---|

| Indítás | Felhasználó prompttal | Felhasználó vagy ütemezés | Webhook, esemény, ütemezés vagy felhasználó |

| Memória | Session-szintű | Feladat-szintű | Perzisztens, környezet-szintű |

| Végrehajtás | Csak szöveges válasz | Tool-hívások, többlépéses | Autonóm, háttérben, Chrome-integráció |

| Ember jelenléte | Kötelező | Opcionális | Csak döntési pontoknál |

| Tipikus felhasználás | Ügyfélszolgálat, Q&A | Kutatás, kódírás | Monitoring, DevOps, proaktív workflow |

30+ új Anthropic funkció 2026 Q1-ben — mi változott?

A Cowork és a Conway csak két név a sok közül. Az Anthropic a negyedévben több mint harminc különálló frissítést adott ki — az AI Maker Substack összefoglalója szerint a legnagyobb hatásúak a következők:

- 1 millió token kontextus — Opus 4.6 és Sonnet 4.6 modellben. Ez nagyjából 750 000 szó, vagyis egy teljes regény vagy egy középvállalat éves jogi dokumentációja elfér egyben.

- Claude Code fejlesztések — perzisztens projekt-memória, git-tudatos refaktorálás, 1M kontextus a CLI-ben

- Computer Use v2 — pontosabb, gyorsabb vizuális észlelés, natív Chrome integráció

- Sub-agent orchestration — agent-eket lehet hierarchikusan szervezni, egy "vezető" szétoszthatja a munkát

- MCP bővítések — a Model Context Protocol mostantól ipari standard a harmadik féltől származó tool-ok csatlakoztatására

- Artifact v3 — interaktív, editálható kimenetek, amelyek Cowork-ben közös állapotot jelentenek

Az 1 millió token kontextus önmagában is paradigmaváltó. Korábban, ha egy ügyfél teljes dokumentációjához akartad "odaadni" az AI-t, RAG-pipeline-t kellett építened, embeddinget, vektor-adatbázist tartottad karban. Mostantól bizonyos feladatokhoz egyszerűbben beviszed az egészet a prompt-ba. Ez nem váltja ki teljesen a RAG-et, de sok use case-nél fölöslegessé teszi.

Mi az MCP és miért kulcsfontosságú?

A Model Context Protocol (MCP) az Anthropic által 2024 végén bevezetett nyílt szabvány, amely egységes, újrahasznosítható módon kapcsolja össze az AI-modelleket külső adatforrásokkal és eszközökkel — fájlrendszerrel, adatbázissal, API-kal, shell-lel. 2026 Q1-re az MCP ipari standarddé vált: már az OpenAI, a Google és a Microsoft is támogatja a saját platformjain.

A Conway és Cowork alapja az MCP. Gyakorlatilag ez jelenti azt, hogy ha ma felépítesz egy MCP-kompatibilis tool-gyűjteményt (pl. "számlázó rendszer API", "CRM olvasó", "dokumentum-kereső"), akkor ugyanez a gyűjtemény holnap használható lesz Claude, GPT-5 és Gemini alatt is — nincs gyártói lock-in. Ez magyar KKV-knak kritikus fontosságú, mert jövőbiztossá teszi az AI-beruházást.

Anthropic 30 milliárd dollár ARR és az enterprise piac

A szám, ami miatt a szakma felkapta a fejét: az Anthropic 2026 Q1-re elérte a 30 milliárd dolláros éves ismétlődő bevételt (ARR). Ez a szám meghaladja az OpenAI enterprise szegmensének bevételét. Még meglepőbb: több mint ezer ügyfél költ évi 1 millió dollár feletti összeget Claude-ra, ami azt jelenti, hogy a nagyvállalati piacon már nem az "egyik jelölt" — hanem az alapértelmezett választás.

Miért? A kutatások és a saját tapasztalatom alapján három okot látok:

- Kódolási teljesítmény. A fejlesztői piacon a Claude 2024 óta listavezető. Mikor a Cursor és a Windsurf beépítette alapmodellként, a piaci elfogadás exponenciálisan gyorsult.

- Biztonság és megfelelés. Az Anthropic Constitutional AI megközelítése vonzóbb a jogászoknak és az adatvédelmi tiszteknek, mint a versenytársak feketedoboz-modelljei. GDPR- és EU AI Act-kontextusban ez súlyos érv.

- MCP ökoszisztéma. A Model Context Protocol lett az ipari standard — az Anthropic itt "gyártói lock-in helyett platform-megközelítés" stratégiát futtat.

Az enterprise piaci mozgás nem csak az Anthropicnak jó hír: a verseny is felgyorsult. A Microsoft Copilot bevezette a "Critique" funkciót — Model Council néven —, amiben az OpenAI GPT-5 generál, egy Claude modell kritikailag felülvizsgálja, és a konszenzus kimenet megy a felhasználóhoz. A Salesforce a Slack-jébe beépített Slackbotot, amely a cég saját bejelentése szerint már 85 000+ belső felhasználót szolgál ki, 96%-os elégedettséggel és heti 20 óra megtakarítással felhasználónként (Salesforce sajtóközlemény).

Anthropic vs OpenAI vs Microsoft — enterprise összevetés

| Dimenzió | Anthropic (Claude) | OpenAI (GPT-5) | Microsoft (Copilot) |

|---|---|---|---|

| Enterprise ARR (2026 Q1) | 30 Mrd USD | 25-28 Mrd USD (becsült) | Office 365-be ágyazva |

| Fő erősség | Kódolás, biztonság, MCP | Multimodal, ökoszisztéma | Integráció, disztribúció |

| Always-on agent | Conway (natív) | Assistants API, Operator | Copilot Agents |

| Max kontextus | 1M token | ~400K token | Modelltől függ |

| Multi-model stratégia | Single vendor | Single vendor | Model Council (Critique) |

A teljes képhez érdemes elolvasnod a GPT-5.4 natív számítógép-irányítás elemzésünket is — az Anthropic Conway és az OpenAI computer use stratégiája párhuzamos, de más filozófiára épül.

Context Engineering — paradigmaváltás prompt engineeringről

Ha csak egyetlen dolgot viszel magaddal ebből a cikkből, ez legyen az: a "prompt engineering" kifejezés elavul. A szakma már "context engineering"-ről beszél. Az Anthropic saját mérnöki útmutatója is erre épül, és a gyakorlatom is megerősíti: a modell kimenetének minőségét 80%-ban nem a prompt-szöveg határozza meg, hanem a kontextus, amit előtte és körülötte építesz.

A context engineering négy pillére:

- System prompts — a modell szerepe, korlátai, kimeneti formátuma

- Tools — milyen eszközökkel érheti el a külvilágot (fájl, API, DB, shell)

- Message history — milyen hosszú és milyen szelektíven kezelt a beszélgetés

- Retrieved context — RAG, embedding, dokumentum-bevitel, memory rendszerek

A gyakorlati következmény magyar fejlesztőknek egyértelmű: nem kell feltétlenül a legnagyobb, legdrágább modellt használnod. Egy Claude Sonnet 4.6, intelligens kontextus-építéssel, gyakran legyőzi az Opus-t egy rosszul felépített prompttal. Ez a tény fontos költség-oldalon, főleg magyar KKV-kontextusban, ahol minden forint számít. Ha nyílt forrású, helyszínen futtatható alternatívát keresel, érdemes a Google Gemma 4 felé is nézni.

Mit jelent ez a magyar KKV-knak?

Most jön a rész, amit a legtöbb nemzetközi elemzés kihagy: mit kezdj ezzel itthon, Dombóvártól Debrecenig?

1. Az EU AI Act árnyékában

2026-ban teljes körűen alkalmazásba lépett az EU AI Act. Az agentic AI sok use case-e magas kockázatú kategóriába esik, főleg HR, hitelbírálat, egészségügy és oktatás területén. Ha Conway-szerű, autonóm ágenst vezetsz be, dokumentálnod kell: mit csinál, mire van hatással, milyen adatot kezel, van-e emberi felülvizsgálati pont. A részletekről az EU AI Act magyar vonatkozásai cikkünkben írtunk.

2. GDPR és permission-aware architektúra

A GDPR nem változott, de az always-on agentek miatt új fogalom vált kötelezővé: permission-aware architektúra. Ez azt jelenti, hogy az agent tisztában van azzal, milyen adatokhoz ki férhet hozzá — és nem szivárogtat. Gyakorlati példa: ha a Conway bejön egy CRM rendszeredbe, és egy ügyfélnek levelet fogalmaz, nem hivatkozhat egy másik ügyfél bizalmas adatára, amit korábban látott.

3. Költség — a rejtett magyar előny

Itt jön egy jó hír: a kisebb modellek + okos kontextus-építés kombináció miatt egy magyar KKV-nak nem kell havi ezer eurós Claude Max előfizetéseket vennie ahhoz, hogy komoly agentet üzemeltessen. Egy jól felparaméterezett Claude Pro (~7 500 Ft/hó/fő), MCP tool-okkal, n8n workflow-val és saját vektor-adatbázissal havi néhány tízezer forintból futtatható. A Claude Max (kb. 40 000-75 000 Ft/hó) csak akkor kell, ha 24/7 Conway-re van szükséged, vagy extrém kontextus-méret kell.

4. Hol érdemes most elkezdeni?

A tapasztalatom alapján három use case működik megbízhatóan magyar kisvállalati környezetben:

- Dokumentum-feldolgozás: számlák, szerződések, árajánlatok automatikus összefoglalása és riportolása

- Ügyfélszolgálati triage: bejövő emailek osztályozása, priorizálása, első válasz-tervezet készítése

- Tartalom-workflow: SEO cikkírás, közösségimédia-poszt generálás, belső tudásbázis karbantartás

Ha ezek valamelyike most is fájó pont nálad, érdemes megnézned az AI agent fejlesztés Magyarországon útmutatónkat, és átolvasni a 2026-os MI stratégia KKV-knak cikkünket.

Mikor, hogyan és mennyiért érhető el?

Jelenleg a Conway zárt bétában fut — az Anthropic 2026 Q2 végére ígéri a szélesebb körű elérhetőséget, várhatóan az Enterprise és a Max csomagban. A Cowork a Claude Code felhasználóknak már elérhető, és a Pro csomagba is lekerül. A The Verge beszámolója szerint a teljes piaci bevezetés 2026 nyarára várható.

Árazásban a Claude Max előfizetés (kb. havi 100-200 USD között) ad teljes Conway-hozzáférést, míg az API-használat tokenalapon továbbra is elérhető. Egy magyar KKV-nak a Claude Pro (~20 USD/hó/fő) csomag jellemzően elég a Cowork használatához; a Conway-hez vagy Max előfizetés, vagy API-integráció kell.

Gyakran ismételt kérdések

Mi a különbség a Claude Conway és a Claude Cowork között?

A Conway egy perzisztens, always-on agent környezet, amely a háttérben fut és eseményekre reagál — tehát "mindig-on" figyelő és cselekvő. A Cowork ezzel szemben egy kollaboratív munkakörnyezet, amelyben több agent egyidejűleg dolgozik ugyanazon a feladaton (pl. egyik kódot ír, másik review-zja). A Conway a "mikor", a Cowork a "kikkel" kérdésre ad választ.

Chatbot vagy agent — mi a különbség?

A chatbot reaktív: egy promptra egy választ ad. Az agent proaktív: folyamatosan fut, állapotot tart, többlépéses terveket készít, és képes cselekedni (tool-hívások, külső API-k) emberi beavatkozás nélkül. A Conway ennek a továbbfejlesztett változata, ahol a "mindig fut" része is megvan.

Mennyibe kerül a Claude Conway egy magyar KKV-nak?

A Conway jelenleg a Claude Max csomag része (kb. havi 100-200 USD, azaz 40 000-75 000 Ft). A Cowork már a Claude Pro-ban is elérhető (~20 USD/hó/fő, azaz 7 500 Ft). Emellett API-integrációval, MCP tool-okkal és n8n workflow-val saját infrastruktúrán is üzemeltethető havi néhány tízezer forintból, ha a kontextust jól építed fel.

Biztonságos Claude Conway-t használni GDPR-szempontból?

Az Anthropic Constitutional AI megközelítése GDPR-kompatibilis, és az enterprise csomagban van zéró retention opció (a modell nem tanul az adataidból). Mindazonáltal az agent autonóm cselekvése miatt permission-aware architektúrát kell kiépítened: pontosan definiáld, milyen adatokhoz fér hozzá, és dokumentáld az EU AI Act követelményei szerint.

Felváltja a Conway a prompt engineering-et?

Nem felváltja, hanem kiegészíti. A "prompt engineering" helyett "context engineering"-ről kezdtünk el beszélni: a modell minőségét 80%-ban a rendszerprompt, a tool-készlet, a beszélgetéstörténet és a retrieved context együtt határozza meg — nem csak a felhasználói prompt szövegezése.

Mikor éri meg magyar KKV-nak agentet bevezetni?

Akkor, ha van ismétlődő, dokumentumokra vagy adatokra épülő workflow, ami hetente 5+ órát vesz el egy munkatársadtól. A Salesforce benchmark 20 óra/hét megtakarítást mutat, de egy magyar KKV-nál már 5-10 óra is megtérül pár hónap alatt. Dokumentum-feldolgozás, ügyfélszolgálati triage, tartalom-workflow — ezek a legjobb belépési pontok.

Mi az MCP és miért fontos?

A Model Context Protocol (MCP) az Anthropic által bevezetett nyílt szabvány, amely egységes módon kapcsolja össze az AI-modelleket külső adatforrásokkal és eszközökkel (fájlrendszer, adatbázis, API, shell). 2026-ra ipari standard lett, amit az OpenAI, Google és Microsoft is támogat. A Conway és Cowork alapja az MCP.

Összegzés és következő lépés

Az Anthropic 2026 Q1-es bejelentései nem egy újabb "gyorsabb chatbot" frissítést jelentenek, hanem paradigmaváltást: a chat-ablak elfogyott, a munkafolyamatba beágyazott, proaktív, mindig-on agent lett az új default. Aki ezt ma még "jövőzenének" hiszi, két év múlva onnan nézi, ahogy a konkurenciája órákat takarít meg naponta.

Ha nem tudod, hol kezdj: ne a legnagyobb modellt vedd meg, ne indulj el ész nélkül egy Conway-beta bevezetésével. Először nézd meg, melyik workflow-d fáj a legjobban, és építs rá egy kicsi, jól paraméterezett agentet. Ha ebben segítség kell, a SocialPro csapata segít a kontextus-építésben, az integrációban és az EU AI Act megfelelésben.

Nézd meg az AI agent fejlesztési szolgáltatásunkat — ingyenes előzetes konzultációval, magyar nyelven, magyar KKV-kra szabva.