Rövid válasz: Az EU AI Act ((EU) 2024/1689 rendelet) az Európai Unió mesterséges intelligenciát szabályozó rendelete, amely 2024. augusztus 1-jén lépett hatályba. Magyarországon a 2025. évi LXXV. törvény és a 344/2025. (X. 31.) Korm. rendelet 2025. december 1-től alkalmazandó. A rendelet minden olyan magyar vállalkozást érint, amely AI-rendszert fejleszt, integrál, forgalmaz vagy használ — mérettől függetlenül. 2025. február 2-tól kötelező az AI literacy (munkavállalói képzés) és a tiltott AI-gyakorlatok kerülése; a nem megfelelés akár 35 millió euró vagy az éves globális árbevétel 7%-ának megfelelő bírsággal, Magyarországon 13,3 milliárd HUF felső határral jár. A high-risk AI rendszerek teljes alkalmazási határideje 2026. augusztus 2.

- Hatály: 2024.08.01.; tiltott gyakorlatok + AI literacy 2025.02.02-től; GPAI 2025.08.02-től

- Magyar végrehajtás: 2025. évi LXXV. törvény + 344/2025. Korm. rendelet, 2025.12.01-től

- High-risk AI teljes alkalmazás: 2026.08.02 (most 4 hónap van rá)

- Bírság: 35M EUR / 7% globális árbevétel; magyar plafon 13,3 milliárd HUF

- Magyar hatóságok: Nemzeti Akkreditáló Hatóság + Nemzetgazdasági Minisztérium + MI Tanács

- Kötelező KKV-knak is: mérettől függetlenül, KKV kedvezményes bírsággal

Források: EUR-Lex (EU) 2024/1689 rendelet, 2025. évi LXXV. törvény (njt.hu), AI Act Explorer, NAIH | Utolsó frissítés: 2026. április 18.

2026 áprilisában minden magyar vállalkozás, amely akár csak ChatGPT-t használ ügyfél-emailek megfogalmazására, AI-alapú CRM-et integrált, vagy automatizált döntéshozó rendszert üzemeltet, az EU AI Act hatálya alá tartozik. A magyar végrehajtási jogszabályok — a 2025. évi LXXV. törvény és a 344/2025. (X. 31.) Korm. rendelet — 2025. december 1-jén léptek hatályba, és a high-risk AI rendszerek teljes körű compliance határideje 2026. augusztus 2. Innen 4 hónap van.

A magyar tanácsadó cégek (Deloitte, BDO, Schoenherr, PwC) elsősorban nagyvállalatoknak szólnak, és az áraik (5–50 millió Ft / projekt) elérhetetlenek a magyar KKV-szektor számára. Ez a cikk gyakorlati, technikai mélységű compliance útmutató magyar KKV-knak, konkrét magyar specifikumokkal, 90 napos implementációs roadmap-pal és forintban kifejezett bírság-tételekkel.

Mi az EU AI Act? — 60 másodperces összefoglaló

Az EU AI Act hivatalos nevén az Európai Parlament és a Tanács (EU) 2024/1689 rendelete a mesterséges intelligenciára vonatkozó harmonizált szabályok megállapításáról. Ez a világ első átfogó, kockázatalapú AI szabályozása. A rendelet közvetlenül alkalmazandó az EU minden tagállamában — nem szükséges hozzá nemzeti átültetés, de a végrehajtási mechanizmusokat (hatóságok, bírság-mértékek, eljárások) az egyes tagállamoknak kell kialakítaniuk.

A rendelet négyrétegű kockázati piramisra épül: minél magasabb az AI rendszer kockázata, annál szigorúbbak a követelmények. A piramis csúcsán a teljes mértékben tiltott gyakorlatok állnak, az alján pedig a minimális kockázatú alkalmazások (pl. spamszűrő, AI-alapú video játékok), amelyekre csak önkéntes magatartási kódexek vonatkoznak.

A rendelet hatálya kiterjed az EU-n kívüli vállalkozásokra is, ha azok AI-rendszerei az EU területén kerülnek forgalomba vagy használatra. Ez a területi hatály hasonlít a GDPR extraterritoriális szabályozására.

Timeline: Mikor mi lép életbe? (2024–2027)

Az EU AI Act fokozatos hatálybalépést alkalmaz. Egy magyar KKV-nak 2026 áprilisában a következő mérföldköveket kell ismernie:

| Dátum | Mi lép életbe | Magyar KKV-t érintő hatás |

|---|---|---|

| 2024.08.01. | EU AI Act hatálybalépés | Általános elvi szabályozás indul |

| 2025.02.02. | Tiltott gyakorlatok tilalma + AI literacy kötelezettség (1. cikk 4. bek.) | Minden cégnek kötelező AI képzés a munkavállalóknak |

| 2025.08.02. | GPAI (General-Purpose AI) szabályok + bírság-mechanizmus + nemzeti hatóságok kijelölése | OpenAI/Anthropic/Google szolgáltatás használata GPAI compliance keretébe esik |

| 2025.12.01. | Magyar végrehajtási törvény (2025. évi LXXV. tv.) + 344/2025 Korm. rendelet | 13,3 mrd HUF bírság-plafon élesedik; magyar hatóságok aktívak |

| 2026.08.02. | High-risk AI rendszerek teljes alkalmazása | Annex III rendszereknek (HR, hitelbírálat, biometria) teljes compliance |

| 2027.08.02. | Pre-existing high-risk AI (azok, amik 2026.08.02 előtt is működtek) compliance határidő | Régóta működő AI rendszerek átvilágítása lezárul |

A legközelebbi kritikus dátum tehát 2026. augusztus 2., amikor a high-risk AI rendszerekre vonatkozó teljes körű kötelezettségek (kockázatkezelés, műszaki dokumentáció, conformity assessment, CE megjelölés) élesednek. Ha a céged Annex III alá tartozó AI-t használ, most 4 hónap van a teljes compliance kialakítására.

A 4 rétegű kockázati piramis — kategóriák magyar példákkal

Az EU AI Act minden AI rendszert egy a négy kockázati kategória egyikébe sorol be. A besorolás meghatározza, milyen kötelezettségek vonatkoznak a rendszerre.

1. Elfogadhatatlan kockázat — 8 tiltott AI gyakorlat (Article 5)

Ezek az AI alkalmazások 2025. február 2. óta teljes mértékben tiltottak az EU-ban. A tilalom megsértése a legmagasabb bírsági kategóriába esik (35M EUR / 7% árbevétel).

- Tudatalatti manipulációs technikák — pl. szubliminális reklám AI-val célzott kárt okozva

- Sebezhető csoportok kihasználása — gyermekek, fogyatékkal élők korlátozott döntésképességének exploitálása

- Social scoring állami szervek által (kínai modell) — természetes személyek általános viselkedés-alapú minősítése

- Bűncselekmény-előrejelzés kizárólag profilalkotás alapján

- Arcfelismerési adatbázis ostromlás — internet vagy CCTV felvételekből arcadatbázis építése

- Munkahelyi és iskolai érzelemfelismerés — kivéve egészségügyi vagy biztonsági okból

- Biometrikus kategorizáció érzékeny tulajdonságok (faj, vallás, szexuális orientáció) szerint

- Valós idejű távoli biometrikus azonosítás nyilvános helyeken bűnüldözés céljából (szűk kivételek)

Magyar KKV szempontból: Ezek a gyakorlatok jellemzően nem érintik a tipikus KKV-t, de óvatosság ajánlott pl. érzelemfelismerő AI-val működő call center szoftverek vagy biometrikus időbélyegző rendszerek esetében.

2. Magas kockázat (high-risk AI) — Annex III

Ez a kategória érinti a legtöbb céges AI alkalmazást. Az Annex III nyolc területet sorol fel, ahol az AI használata high-risk besorolást kap:

- Biometrikus azonosítás és kategorizálás (kivéve szigorúan vett ellenőrzés)

- Kritikus infrastruktúra menedzselés (energiaellátás, közlekedés, vízszolgáltatás)

- Oktatás és képzés — diákok értékelése, felvételi döntések

- Foglalkoztatás, HR menedzsment — CV szűrő AI, munkavállaló-monitoring, teljesítményértékelés

- Alapvető magán- és közszolgáltatáshoz való hozzáférés — hitelbírálat, biztosítási scoring, segélyek elbírálása

- Bűnüldözés — bizonyíték-értékelés, kockázat-előrejelzés

- Migrációkezelés és határellenőrzés

- Igazságszolgáltatás és demokratikus folyamatok — jogi döntéstámogatás, választási befolyásolás detektálás

Magyar KKV példák a high-risk kategóriában:

- Egy magyar fintech, amely AI-alapú scoring rendszerrel hitelbírálatot végez kisvállalkozásoknak — high-risk

- Egy HR-tech KKV, amely CV-szűrő AI-t ad el toborzó cégeknek — high-risk

- Egy oktatási SaaS, amely diákok teljesítményét értékeli AI-val — high-risk

- Egy biztosítási alkusz cég, amely kárértékelő AI-t használ — high-risk

A high-risk kategóriába eső rendszerek esetében 9 compliance pillérnek kell megfelelni (lásd lejjebb), valamint conformity assessment + CE megjelölés kötelező 2026. augusztus 2-tól.

3. Korlátozott kockázat — transzparencia kötelezettség

Ide tartoznak az olyan AI rendszerek, amelyek közvetlen interakcióba lépnek természetes személyekkel vagy AI-generált tartalmat hoznak létre. A fő kötelezettség: a felhasználónak tudnia kell, hogy AI-val kommunikál vagy AI-generált tartalmat fogyaszt.

- AI chatbot egy webshop ügyfélszolgálatán — kötelező jelezni, hogy ez nem ember

- AI-generált képek és videók (deepfake, szintetikus tartalom) — címkézési kötelezettség

- AI-generált szöveges hírtartalom — közlési kötelezettség, ha közérdekű ügyről szól

- Érzelemfelismerő rendszerek (megengedett kontextusban)

Magyar KKV gyakorlat: Ha a céged ChatGPT-alapú ügyfélszolgálati chatbotot üzemeltet, a chat ablakban kötelező feltüntetni: „Ön egy mesterséges intelligencia asszisztenssel beszél." vagy hasonló közlést. A vonatkozó követelményekről részletesen az AI átláthatóság oldalunkon olvashatsz.

4. Minimális kockázat — magatartási kódexek

Az AI alkalmazások többsége (becslés szerint 80-85%) ebbe a kategóriába esik. Példák: spamszűrő, AI a videójátékokban, AI-alapú dokumentumkezelés, ajánlórendszerek e-kereskedelemben (alacsony kockázattal).

Ezekre a rendszerekre csak önkéntes magatartási kódexek vonatkoznak — semmilyen kötelező compliance nem szükséges. Az AI Act azonban itt is bátorítja a self-regulation gyakorlatát.

Magyar implementáció: 2025. évi LXXV. törvény és 344/2025. Korm. rendelet

2025. október 31-én kihirdették és 2025. december 1-jén hatályba lépett a 2025. évi LXXV. törvény az EU AI Act magyarországi végrehajtásáról. Ezzel egyidejűleg jelent meg a 344/2025. (X. 31.) Korm. rendelet, amely a részletszabályokat állapítja meg. Magyarország ezzel az elsők között teljesítette a tagállami implementációs kötelezettséget.

Nemzeti Akkreditáló Hatóság (AI Notification Authority)

A magyar törvény a Nemzeti Akkreditáló Hatóságot (NAH) jelölte ki AI Notification Authority-ként. Ez a szerv felelős a megfelelőségértékelő testületek (notified bodies) akkreditációjáért, amelyek a high-risk AI rendszerek conformity assessment-jét végzik.

Magyar KKV szempontból: ha high-risk AI rendszert akarsz piacra dobni, a CE megjelölés megszerzéséhez egy notified body általi értékelés szükséges. A NAH listáján szereplő testületekkel kell dolgozni.

Nemzetgazdasági Minisztérium (AI Market Surveillance Authority)

A piacfelügyeleti szerepet a Nemzetgazdasági Minisztérium tölti be. Ez a szerv jogosult AI compliance ellenőrzésre, információkérésre, AI rendszerek piacról való visszahívására, valamint bírság kiszabására. Az ellenőrzések 2026 második felében várhatóan felgyorsulnak a high-risk AI 2026.08.02-i határidő miatt.

Magyar Mesterséges Intelligencia Tanács (MI Tanács)

2025. december 1-vel létrejött a Magyar Mesterséges Intelligencia Tanács, amely tanácsadó testületként működik. Tagjai között vannak az iparág, az akadémia, a civil szféra és a kormányzat képviselői. A Tanács feladata az AI politika koordinációja, állásfoglalások kiadása, és a magyar AI ökoszisztéma fejlesztésének segítése.

13,3 milliárd HUF bírság felső határ

A magyar törvény a magyar vállalkozásokra alkalmazandó bírság felső határát 13,3 milliárd forintban rögzíti — ez a 35 millió eurós EU plafon hozzávetőleges forint-ekvivalense (350 Ft/EUR árfolyammal). A pontos összeg az EUR/HUF árfolyamtól függ az ellenőrzés időpontjában.

NAIH és AI Act átfedés

A Nemzeti Adatvédelmi és Információszabadság Hatóság (NAIH) nem közvetlen AI Act felügyelő szerv, de számos kompetencia-terület átfed: biometrikus adatkezelés, automatizált döntéshozatal, profilalkotás. NAIH állásfoglalások figyelése és GDPR + AI Act együttes compliance kialakítása kritikus magyar KKV-knak.

Kinek kell megfelelnie? — 5 szereplő szerepköre

Az EU AI Act öt fő szereplőt különböztet meg, eltérő kötelezettségekkel. Egy magyar KKV gyakran több szerepkörben is megjelenhet egyszerre.

| Szereplő | Definíció | Magyar KKV példa |

|---|---|---|

| Provider (szolgáltató) | AI rendszert fejleszt és piacra visz a saját nevében | Magyar AI agency saját CRM AI-t ad el |

| Deployer (alkalmazó) | AI rendszert használ üzleti tevékenysége során | KKV ChatGPT-vel ír ügyfél-emailt |

| Importer (importőr) | EU-n kívüli AI rendszert hoz be az EU piacra | Magyar viszonteladó USA-ból AI eszközt importál |

| Distributor (forgalmazó) | AI rendszert továbbforgalmaz az ellátási láncban | Magyar SaaS reseller harmadik fél AI eszközét adja |

| Authorized representative | EU-n kívüli provider EU képviselője | Magyar tanácsadó képviseli az ügyfelét EU-n belül |

A leggyakoribb magyar KKV szerepkör a deployer — vagyis aki AI eszközöket (ChatGPT, Claude, Gemini, Microsoft Copilot, AI alapú CRM stb.) használ. Erre a szerepkörre is vonatkozik AI literacy kötelezettség, transzparencia előírás és high-risk AI esetén risk management.

AI literacy (1. cikk 4. bek.) — A 2025.02.02 óta kötelező munkavállalói képzés

Az AI literacy kötelezettség talán a leggyakrabban félreértett rendelkezés. Az 1. cikk 4. bekezdése szerint a provider-eknek és deployer-eknek biztosítaniuk kell, hogy a személyzetük rendelkezzen az AI rendszerek megfelelő használatához szükséges szintű AI ismeretekkel. Ez 2025. február 2. óta hatályban van, és mérettől függetlenül minden cégre vonatkozik.

Kit érint?

- Fejlesztők és adattudósok — akik AI modellt képeznek vagy integrálnak

- Termékmenedzserek — akik AI funkciók termékbe építéséért felelősek

- Ügyfélszolgálati munkatársak — akik AI chatbottal vagy asszisztenssel dolgoznak

- HR és toborzók — akik AI-alapú CV szűrőt, interjú-elemzőt használnak

- Marketing és sales — akik AI-val generálnak tartalmat vagy outreach-ot

- Vezetők és felelős személyek — akik AI-projekteket jóváhagynak

Minta AI literacy tematika (8 modul, 4-6 óra)

- AI alapok — Mi az AI, ML, LLM? Hogyan működik? (60 perc)

- EU AI Act jogi háttér — Kockázati besorolás, kötelezettségek, bírságok (45 perc)

- Magyar specifikumok — 2025. évi LXXV. tv., NAIH, magyar hatóságok (30 perc)

- Adatvédelmi alapok — GDPR + AI Act átfedés, érzékeny adatok (45 perc)

- Konkrét eszközök használata — ChatGPT, Claude, Copilot felelős használat (60 perc)

- Promptolás és bias kezelés — Torzítás felismerése, prompt injection elleni védekezés (45 perc)

- Transzparencia és dokumentáció — AI használat naplózása, ügyfél tájékoztatás (30 perc)

- Incidens kezelés — Mit tegyünk, ha AI hibázik? Eszkalációs eljárás (30 perc)

Dokumentáció — kötelező nyilvántartás

Az AI literacy nem opcionális vagy informális képzés. A cégnek bizonyítania kell, hogy a képzés megtörtént, dokumentált és a munkakörhöz igazodott. Javasolt minimumtartalmak:

- Tematika (mely modulok, milyen időtartam)

- Résztvevők névsora és aláírt jelenléti ív

- Tesztkérdések és értékelés (legalább alapszintű)

- Frissítési ütemterv (évente legalább egyszer ajánlott)

- Felelős személy megnevezése (AI literacy officer)

High-risk AI: a 9 compliance pillér

Ha a céged Annex III alá tartozó AI rendszert fejleszt (provider) vagy használ (deployer), 2026. augusztus 2-tól a következő 9 compliance pillérnek kell megfelelnie:

- Kockázatkezelési rendszer — folyamatos kockázat-azonosítás, -értékelés, -enyhítés a teljes életciklus alatt

- Adatgazdálkodás — tréning, validációs és teszt adatok minőségi követelményei (relevancia, reprezentativitás, hibamentesség)

- Műszaki dokumentáció — Annex IV szerinti részletes dokumentáció (rendszer leírás, adatok, képzés, teljesítmény)

- Naplózás (logging) — automatikus eseménynaplózás, nyomon követhetőség

- Transzparencia — felhasználónak adott információk, használati utasítás

- Emberi felügyelet (human oversight) — természetes személy által megvalósítható kontroll, intervenciós lehetőség

- Pontosság, robosztusság, kiberbiztonság — műszaki teljesítmény és biztonsági követelmények

- Minőségirányítási rendszer (QMS) — provider-ek számára kötelező, ISO 9001 vagy ISO 42001 alapon

- Conformity assessment + CE megjelölés — megfelelőségértékelés, EU megfelelőségi nyilatkozat, CE jelölés

Ezeket részletesebben az AI governance keretrendszer kialakítása szolgáltatási oldalunkon tekintheted át, konkrét sablonokkal és checklist-tel.

90 napos compliance roadmap magyar KKV-knak

Egy 5-50 fős magyar KKV számára 90 nap alatt megalapozható az alapszintű EU AI Act compliance. Az alábbi roadmap konkrét lépéseket és ROI-t kínál.

0-30 nap: AI inventory és kockázati besorolás

- 1-7. nap: AI inventory készítése — minden AI eszköz, AI-funkciójú szoftver és AI-szolgáltatás felmérése (ChatGPT licencek, AI funkciók a CRM-ben, marketing AI eszközök, HR AI eszközök)

- 8-14. nap: Minden AI rendszer kockázati besorolása (tiltott / high-risk / korlátozott / minimális)

- 15-21. nap: Provider/deployer/importőr szerepkör tisztázása minden rendszerre

- 22-30. nap: AI policy első verziójának megfogalmazása — mit használhat a cég, mit nem, milyen feltételekkel

30-60 nap: AI policy + literacy tréning

- 31-40. nap: AI policy véglegesítése, vezetői jóváhagyás, kommunikáció minden munkavállalónak

- 41-50. nap: AI literacy tréning lebonyolítása (8 modul, 4-6 óra), dokumentáció elkészítése

- 51-60. nap: Transzparencia kötelezettségek implementálása — chatbot disclosurok, AI-generált tartalom címkézés, ügyfél tájékoztató szövegek

60-90 nap: Műszaki dokumentáció + kontrollok

- 61-70. nap: High-risk AI rendszerek esetén műszaki dokumentáció elkészítése (Annex IV alapon)

- 71-80. nap: Logging és audit trail bevezetése — minden AI használat naplózása, megőrzési idő meghatározása

- 81-90. nap: Incidens jelentési protokoll bevezetése (15 napos jelentési határidő a piacfelügyeleti hatóság felé)

90+ nap: Folyamatos monitoring és továbbfejlesztés

- Negyedéves AI inventory frissítés

- Évi 1x AI literacy refresh tréning

- Hosszú táv: ISO/IEC 42001 (AI Management System) tanúsítás megfontolása

- 2026. augusztus 2. előtt: high-risk AI rendszerek conformity assessment + CE megjelölés (notified body bevonásával)

AI audit folyamat — technikai mélység

Az AI audit az AI rendszerek független, módszeres átvizsgálása. Magyar KKV-knak különösen ajánlott high-risk AI piacra vitele előtt, új AI eszköz bevezetésekor, AI incidens után, vagy évente legalább egyszer.

Mit vizsgál egy AI audit?

- Kockázati besorolás helyessége — biztosan a megfelelő kockázati kategóriában van a rendszer?

- Adatminőség és bias — a tréning adatok reprezentatívak, hibamentesek?

- Modell teljesítmény — pontosság, false positive/negative arányok

- Dokumentáció teljessége — Annex IV követelményeknek megfelel a műszaki dokumentáció?

- Logging és naplózás — minden eseményt rögzít a rendszer?

- Transzparencia compliance — felhasználói tájékoztatások megfelelőek?

- Emberi felügyelet — van valódi intervenciós lehetőség?

- Kiberbiztonság — adversarial attack-ok, prompt injection ellen védelem

Belső vs. külső audit

Belső AI audit: Cégen belüli compliance officer vagy AI governance team végzi. Olcsóbb (200 000 - 500 000 Ft / projekt internal cost), de korlátozott a függetlensége. Negyedéves vagy féléves rendszerességgel ajánlott.

Külső AI audit: Független harmadik fél végzi (tanácsadó cég, vagy notified body high-risk esetén). Drágább (1 - 5 millió Ft / audit egy KKV-nál), de szükséges high-risk AI piacra vitele előtt és audit nyom (audit trail) bizonyítékként.

Eszközök AI audithoz

- MLflow — model versioning, experiment tracking

- Weights & Biases (wandb) — model training monitoring

- Evidently AI — production ML monitoring, data drift detection

- Fiddler AI — model performance monitoring + bias detection

- SHAP / LIME — modell explainability

- IBM Fairness 360 — bias és fairness mérés

Ha érdekel egy konkrét AI audit folyamat magyar KKV-d számára, nézd meg az EU AI Act megfelelőségi szolgáltatásunkat, ahol fix árú audit csomagokat kínálunk.

Bírságok és szankciók — 3 szintű büntetési rendszer

Az EU AI Act három szintű bírság-rendszert vezet be. A magasabb összeg vagy százalék érvényesül — kivéve KKV-k és startup-ok esetén, ahol az alacsonyabb összeg.

| Kategória | Sértés | Bírság (max) | KKV kedvezmény |

|---|---|---|---|

| 1. (legsúlyosabb) | Tiltott AI gyakorlatok használata | 35 M EUR vagy 7% globális árbevétel | Az alacsonyabb érvényesül |

| 2. (közepes) | High-risk compliance hiánya, kötelezettség-szegés | 15 M EUR vagy 3% árbevétel | Az alacsonyabb érvényesül |

| 3. (legenyhébb) | Hiányos vagy hamis információ-szolgáltatás hatóságnak | 7,5 M EUR vagy 1% árbevétel | Az alacsonyabb érvényesül |

Magyar specifikum: A 2025. évi LXXV. törvény a magyar KKV-kra a bírság-plafont 13,3 milliárd HUF-ban rögzíti (≈ 35 M EUR @ 380 Ft/EUR árfolyam). Egy 100 millió Ft-os éves árbevételű KKV maximum 7%-a, vagyis 7 millió Ft bírságot kaphat tiltott gyakorlat esetén — ez a kisebb a két érték közül.

AI Governance keretrendszer — Three Lines of Defence modell

Az AI governance nem csak compliance ügy — egy menedzsment keretrendszer, ami biztosítja, hogy az AI használata összhangban legyen a cég stratégiájával, kockázat-toleranciájával és értékeivel. A PwC és más tanácsadók által javasolt megközelítés a Three Lines of Defence (3LoD) modell:

- 1. védelmi vonal: Operatív szint — fejlesztők, adattudósok, termékmenedzserek. Napi AI használat, kontrollok beépítése.

- 2. védelmi vonal: Risk management és compliance — független felügyelet, policy-k kidolgozása, kockázat-monitoring.

- 3. védelmi vonal: Belső audit — független ellenőrzés, board-nak jelentés.

RACI mátrix — ki miért felel?

Egy AI governance keretrendszerben tisztán definiálni kell a felelősségi köröket (RACI: Responsible, Accountable, Consulted, Informed). Egy tipikus magyar KKV-nál:

- CEO / ügyvezető: Accountable — végső felelős az AI compliance-ért

- CTO / IT vezető: Responsible — technikai implementáció

- Adatvédelmi tisztviselő (DPO): Consulted — GDPR + AI Act átfedés

- HR vezető: Responsible — AI literacy tréning lebonyolítása

- Jogi tanácsadó: Consulted — szerződések, jogi vélemények

- Minden munkavállaló: Informed — AI policy ismerete

Magyar specifikumok — amit a nemzetközi források nem fednek

NAIH és AI Act átfedés

A NAIH 2025-ös állásfoglalásai szerint az AI használata során a GDPR és az AI Act egyszerre alkalmazandó — egyik nem váltja ki a másikat. Különös figyelem: biometrikus adatkezelés, automatizált döntéshozatal (GDPR 22. cikk), profilalkotás, és érzékeny adatok AI-tréninghez használata.

Magyar MI Stratégia 2025-2030

A magyar kormány Magyar MI Stratégia 2025-2030 dokumentuma kiegészíti az EU AI Act keretrendszerét nemzeti politikai irányelvekkel. A stratégia kiemelt területei: AI a közigazgatásban, AI az oktatásban, AI a gyártásban, és a magyar AI ökoszisztéma fejlesztése (MI Tanács, sandbox programok, GINOP/DIMOP pályázatok).

Government Commissioner for AI

2025-ben kinevezett Government Commissioner for AI (magyar AI kormánybiztos) felelős a végrehajtás politikai koordinációjáért. Ez a szerep nem szabályozási szerep, hanem stratégiai koordinációs feladat.

ISO 56001 + EU AI Act kombinált pályázat (GINOP, DIMOP)

A 2026-os pályázati ciklusban a DIMOP+ 1.2.6 és más Széchenyi Terv Plusz pályázatok támogatják az AI governance és ISO 56001 (innovation management) tanúsítások bevezetését. KKV-k akár 3-12 millió Ft vissza nem térítendő támogatást kaphatnak EU AI Act compliance projekthez kapcsolódó IT fejlesztésre.

SocialPro EU AI Act compliance csomag — KKV-knak fix áron

A magyar tanácsadó cégek (Deloitte, BDO, Schoenherr) jellemzően 5-50 millió Ft-os, projekt-alapú szolgáltatást kínálnak — ami egy KKV-nak elérhetetlen. A SocialPro ezért fix árú compliance csomagokat kínál:

- EU AI Act Starter Kit: 1,5 millió Ft + ÁFA — AI inventory + kockázati besorolás + AI policy + literacy tréning (90 nap)

- Governance Full: 3,5 millió Ft + ÁFA — Starter Kit + műszaki dokumentáció + audit trail + 6 hónap support

- High-risk AI Compliance: egyedi árazás — teljes Annex IV dokumentáció + conformity assessment támogatás + CE megjelölés

Részletek: EU AI Act megfelelőségi szolgáltatás oldalunkon. A megközelítésünk része a compliance-ready AI agent fejlesztés is, ahol már a tervezésnél beépítjük az AI Act követelményeket.

Hogyan kezdj neki most? — 3 lépés ezen a héten

- 1. lépés (ma): Készíts egy gyors AI inventory-t — listázz minden AI eszközt és AI-funkciójú szoftvert, amit a céged használ (ChatGPT, Microsoft Copilot, AI a CRM-ben, AI a HR-tech eszközben stb.)

- 2. lépés (ezen a héten): Indítsd el az AI literacy tréninget — minimum 2-3 órás bevezető képzés minden munkavállalónak, dokumentált jelenléti ívvel

- 3. lépés (30 napon belül): Kérd ingyenes 30 perces EU AI Act kockázati konzultációnkat → kapcsolat

Az időablak 2026. augusztus 2-ig tart — addig kell teljesítened a high-risk AI rendszereid teljes compliance-ét. Innen kevesebb mint 4 hónap van.

Bírságolási gyakorlat magyar piacon — NAIH precedens, AI Pact és AI registry

Az EU AI Act bírságolási mechanizmusa 2025. augusztus 2-tól élesedett, a magyar Nemzetgazdasági Minisztérium piacfelügyeleti hatáskörrel pedig 2025. december 1-től bír. Konkrét AI Act bírság-precedens még nem született Magyarországon (2026. április), de a NAIH GDPR bírságolási gyakorlata jó iránymutatást ad, mire számíthat egy magyar KKV.

NAIH GDPR bírságok mint bírságolási referencia (2020-2025)

A NAIH az elmúlt 5 évben kiszámítható bírságolási gyakorlatot alakított ki, amely az AI Market Surveillance Authority (Nemzetgazdasági Minisztérium) gyakorlatára is hatással lesz:

- DIGI Kft. — 100 millió Ft (2020) — adatvédelmi incidens bejelentés elmulasztása, biztonsági intézkedések hiánya

- Magyar Telekom — 250 millió Ft (2022) — direkt marketing célú adatkezelés hozzájárulás nélkül

- UniCredit Bank — 80 millió Ft (2023) — automatizált döntéshozatali rendszer GDPR 22. cikk megsértése (hitel scoring)

- Kisebb KKV-k — 1-15 millió Ft tartomány — átlagos bírságok hozzájárulás nélküli adatkezelésre, hiányos adatvédelmi tájékoztatóra

Várható AI Act bírság-mértékek magyar KKV-knál (becslés a NAIH gyakorlat alapján):

- AI literacy hiánya, dokumentáció nélkül: 500 ezer - 5 millió Ft (3. kategória, hiányos információ)

- Transzparencia kötelezettség elmulasztása (chatbot disclosure, deepfake címkézés): 2-15 millió Ft (2. kategória)

- High-risk AI compliance hiánya KKV-nál: 10-100 millió Ft (2. kategória, 3% árbevétel cap)

- Tiltott AI gyakorlat (pl. munkahelyi érzelemfelismerés): 50-500 millió Ft + tevékenységi tilalom (1. kategória, 7% árbevétel cap)

AI Pact — Európai Bizottság önkéntes vállalása magyar KKV-knak

Az AI Pact az Európai Bizottság AI Office által kezdeményezett önkéntes program, amelyhez 2026. áprilisában már 130+ EU vállalat csatlakozott (Microsoft, OpenAI, Anthropic, Google, SAP, valamint magyar oldalról a Magyar Telekom és a Richter Gedeon). A magyar KKV-k számára a csatlakozás ingyenes, és három kötelezettségvállalást tartalmaz: (1) AI governance keretrendszer kialakítása a határidő előtt, (2) high-risk AI rendszerek azonosítása és bejelentése, (3) AI literacy program implementálása.

A csatlakozás előnye magyar KKV-nak: bizonyíthatóan jóhiszemű compliance törekvés (mitigáló tényező bírság kiszabásánál), korai hozzáférés EU iránymutatásokhoz, valamint piaci megkülönböztető tényező B2B tendereken (különösen állami beszerzéseknél).

AI rendszer nyilvántartás (AI registry) — kötelező belső dokumentáció

Bár a 344/2025. Korm. rendelet nem ír elő központi AI nyilvántartási kötelezettséget magyar KKV-knak (csak high-risk AI provider-eknek az EU AI Database-ben), a belső AI registry vezetése erősen ajánlott — a Nemzetgazdasági Minisztérium ellenőrzés esetén ezt elsőként fogja kérni. Egy minimális AI registry tartalma:

- Rendszer azonosító (név, verzió, szállító, integráció dátuma)

- Kockázati besorolás (tiltott / high-risk / korlátozott / minimális, indoklással)

- Cég szerepköre (provider / deployer / importer / distributor)

- Adatkezelési alap (GDPR jogalap, adatkategóriák, megőrzési idő)

- Felelős személy (system owner, AI literacy officer)

- Felülvizsgálat (utolsó audit dátuma, következő ellenőrzés)

Auditor és tanácsadó piac Magyarországon — díjszabások 2026

A magyar AI Act tanácsadói piac 2026. áprilisra differenciálódott. A költségek nagyban függnek a cég méretétől és a high-risk AI rendszerek számától:

- Belső compliance officer kinevezés: 0 Ft direkt költség, 200-500 ezer Ft / negyedév belső erőforrás-ráfordítás

- KKV-fókuszú boutique tanácsadók (SocialPro, kisebb jogi irodák): 500 ezer - 3 millió Ft / projekt (AI inventory + policy + literacy)

- Big Four tanácsadók (Deloitte, PwC, KPMG, EY): 5-25 millió Ft / projekt nagyvállalati ügyfeleknek

- Notified body conformity assessment (high-risk AI CE jelölés): 3-15 millió Ft / rendszer (NAH által akkreditált testület)

- ISO/IEC 42001 tanúsítás (AI Management System): 2-8 millió Ft első évben, évi 0,5-2 millió Ft fenntartás

GPAI modellek új szabályai 2026-tól — ChatGPT, Claude, Gemini céges használat

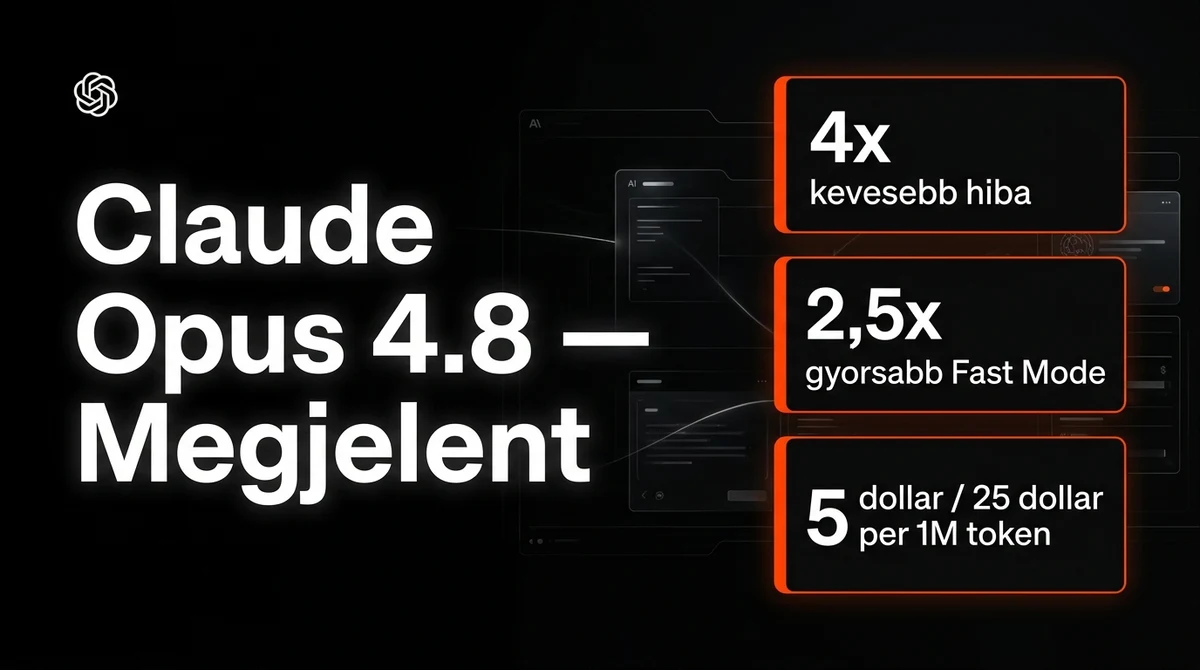

A 2025. augusztus 2-tól hatályos GPAI (General-Purpose AI) szabályok szerint a nagy nyelvi modellek (ChatGPT, Claude, Gemini, Mistral) szolgáltatói külön kötelezettségek alá esnek, beleértve a műszaki dokumentáció, copyright megfelelés és tréningadat-összefoglaló közzétételét. A 10^25 FLOPS feletti modellek (GPT-5, Claude Opus 4, Gemini 3 Ultra) "systemic risk" kategóriába esnek, ami további kötelezettségeket ír elő (red teaming, incident reporting, kiberbiztonsági audit).

Magyar KKV deployer-ként a következőkre kell figyelni: (1) használat csak EU AI Act-konform GPAI provider-től (OpenAI EU AI Act compliance dokumentáció elérhető), (2) a GPAI által generált tartalom transzparens címkézése, (3) érzékeny személyes adatok ne kerüljenek a promptokba GDPR-szempontból, (4) belső használati policy az AI hallucinációk miatt (pl. orvosi, jogi, pénzügyi területen ne legyen final decision a modell outputja).

90 napos compliance case study — fiktív magyar HR-tech KKV

Egy konkrét eset jobban szemlélteti a 90 napos roadmap költségeit és nehézségeit, mint a sablon. Bemutatjuk egy fiktív, de realisztikus magyar HR-tech KKV (nevezzük el: "TalentMatch Hungary Kft.") compliance útját.

Kiindulási helyzet (Day 0)

- Cég profil: 22 fős HR-tech KKV Budapest, 480 millió Ft éves árbevétel

- Termék: SaaS CV-szűrő AI, 35 magyar KKV ügyfél, AI alapú jelölt-rangsorolás

- Szerepkör: provider (saját fejlesztésű AI) + deployer (ChatGPT-t használnak belső copywritinghez)

- Problémák: nincs AI policy, nincs literacy tréning, nincs műszaki dokumentáció, nincs bias audit

- Kockázat: high-risk AI (Annex III, foglalkoztatás), 2026.08.02-tól teljes compliance kötelező

Hónap 1 (Day 1-30): AI inventory, kockázati besorolás, policy alapok — 850 ezer Ft

- 1. hét: AI inventory (saját CV-szűrő modell, ChatGPT licencek, Notion AI, GitHub Copilot, marketing AI eszközök) → 12 AI rendszer azonosítva

- 2. hét: Kockázati besorolás → 1 high-risk (CV-szűrő), 3 korlátozott kockázat (chatbot, AI tartalomgenerálás), 8 minimális

- 3. hét: Külső jogi audit (ügyvédi iroda) — 600 ezer Ft + ÁFA, 8 órás díj

- 4. hét: AI policy 1.0 véglegesítés, vezetői jóváhagyás → 250 ezer Ft belső munkaóra-érték

- Költség: 850 ezer Ft (külső jogi tanácsadás + belső munkaerő)

Hónap 2 (Day 31-60): AI literacy tréning + transzparencia — 720 ezer Ft

- 5-6. hét: Online AI literacy tréning vásárlása minden 22 munkavállalónak (kurzusdíj 12 ezer Ft / fő × 22 = 264 ezer Ft) + 4 órás interaktív workshop magyar AI Act szakértővel (300 ezer Ft)

- 7. hét: Tesztek lebonyolítása, jelenléti ívek, dokumentáció → AI literacy officer kinevezése (HR vezető, +ÁFA)

- 8. hét: Transzparencia implementálás — chatbot disclosure UI, ÁSZF + adatkezelési tájékoztató frissítése (jogi költség 156 ezer Ft + fejlesztői munka 0 Ft, belső)

- Költség: 720 ezer Ft

Hónap 3 (Day 61-90): Műszaki dokumentáció + bias audit + logging — 1,8 millió Ft

- 9-10. hét: Annex IV műszaki dokumentáció (rendszerleírás, adatok, képzés, teljesítmény metrikák, ismert korlátok) → boutique AI tanácsadó: 900 ezer Ft + ÁFA

- 11. hét: Bias audit a CV-szűrő modellen (IBM Fairness 360 + manuális elemzés nemi és életkor szerinti torzításra) → külső adattudós: 450 ezer Ft + ÁFA

- 12. hét: Logging infrastruktúra fejlesztés (minden AI prediction naplózása 5 évre, audit trail) → 6 fejlesztői nap belső, +saját AWS költség 80 ezer Ft / hó plusz

- 13. hét: Incidens jelentési protokoll (15 napos határidő a piacfelügyeleti hatóság felé), human oversight UI a CV-szűrő rendszerben → 350 ezer Ft fejlesztői munka

- Költség: 1,8 millió Ft

Eredmény: 90 nap múlva (Day 90)

- Teljes compliance költség: 3,37 millió Ft + 80 ezer Ft / hó folyamatos infrastruktúra-költség

- Bírság-kockázat csökkentés: potenciális 50 millió Ft+ bírság elkerülése (ROI 14x)

- Új ügyfél: 2 állami szektorbeli ajánlatkérésre lett alkalmas (AI Pact tagság + dokumentáció előny)

- Hátralévő feladatok 2026.08.02-ig: notified body conformity assessment + CE megjelölés (becslés: további 4 millió Ft)

A teljes első éves AI Act compliance költségvetés egy 22 fős high-risk AI provider KKV-nál: 7,5-9 millió Ft, ami az éves árbevétel 1,5-2%-a. Ehhez képest egy nagyvállalati Big Four projekt 25-50 millió Ft, vagyis 5-7x költségesebb. Részletes árazási példáink a EU AI Act megfelelőségi szolgáltatás oldalunkon érhetők el.

Gyakori kérdések (GYIK) az EU AI Act-ről

Az alábbi kérdéseket magyar cégvezetőktől, IT vezetőktől és compliance tisztviselőktől kaptuk leggyakrabban 2026 első negyedévében.