Az EU AI Act (az Európai Unió mesterséges intelligencia rendelete) a világ első átfogó MI-szabályozása, amely 2024. augusztus 1-jén lépett hatályba és 2026. augusztus 2-tól teljes mértékben alkalmazandó. A rendelet kockázat-alapú megközelítést alkalmaz: a tiltott gyakorlatoktól a minimális kockázatú rendszerekig négy kategóriába sorolja az AI alkalmazásokat. Magyarországon az NMHH (Nemzeti Média- és Hírközlési Hatóság) látja el a felügyeletet, a bírságok akár 37,2 millió euróig (13,3 milliárd Ft) terjedhetnek. A SocialPro AI governance szolgáltatása segít a magyar vállalkozásoknak felkészülni a megfelelésre.

Mi az EU AI Act és miért fontos a magyar vállalkozásoknak?

Az EU AI Act (Regulation (EU) 2024/1689) az Európai Unió egységes mesterséges intelligencia szabályozása, amely minden EU tagállamban — így Magyarországon is — közvetlenül alkalmazandó. A rendelet célja, hogy biztosítsa az AI rendszerek biztonságos, átlátható és emberi jogokat tiszteletben tartó használatát.

A Török Balázs (2026) elemzése szerint a magyar vállalkozások többsége már használ valamilyen AI eszközt — ChatGPT-t, automatizációs botokat, AI-alapú analitikát —, de a legtöbben nincsenek tisztában a jogszabályi kötelezettségeikkel. Az AI Act nem csak a fejlesztőkre vonatkozik: az AI rendszerek felhasználóira (deployers) is kötelezettségeket ró.

A Eubility (2026) figyelmeztetése egyértelmű: „Az AI megfelelőség 2026. február 2-től már nem választható opció, hanem jogi kötelezettség."

Hogyan épül fel az EU AI Act kockázati rendszere?

A rendelet kockázat-alapú megközelítést alkalmaz — minél nagyobb kockázatot jelent egy AI rendszer az emberek jogaira és biztonságára, annál szigorúbb szabályok vonatkoznak rá.

| Kockázati szint | Mit jelent | Példák | Teendő |

|---|---|---|---|

| Tiltott (elfogadhatatlan kockázat) | Ezeket az AI alkalmazásokat teljes mértékben tiltja a rendelet | Social scoring rendszerek, manipulatív AI technikák, érzékeny jellemzők alapján történő biometrikus kategorizálás, prediktív rendészet | Azonnal leállítani, ha ilyet használ |

| Magas kockázat | Szigorú megfelelési követelmények — kockázatértékelés, dokumentáció, emberi felügyelet kötelező | Toborzási AI (CV szűrés), hitelképesség-értékelés, oktatási rendszerek, bűnüldözési kockázatértékelés, kritikus infrastruktúra kezelés | Conformity assessment, dokumentáció, monitorozás, emberi felügyelet |

| Korlátozott kockázat | Átláthatósági kötelezettségek | Chatbotok, deepfake generátorok, AI által generált tartalom | Jelezni kell a felhasználónak, hogy AI-val kommunikál |

| Minimális kockázat | Nincs szabályozási kötelezettség | Spam szűrők, AI-alapú videójátékok, ajánlórendszerek | Nincs kötelezettség (önkéntes magatartási kódex ajánlott) |

A artificialintelligenceact.eu összefoglalója szerint a legtöbb magyar KKV a korlátozott kockázat kategóriába esik — ha chatbotot, AI tartalom generálót vagy AI agentet használ, legalább az átláthatósági kötelezettségeknek meg kell felelnie.

Milyen ütemtervvel lép életbe a szabályozás?

Az EU AI Act fokozatosan válik alkalmazandóvá — a hatályba lépés (2024. augusztus 1.) után különböző határidők vonatkoznak a különböző kockázati kategóriákra:

| Dátum | Mi lép életbe | Kit érint |

|---|---|---|

| 2025. február 2. | Tiltott AI gyakorlatok tilalma | Minden vállalkozás — aki tiltott AI-t használ, azonnal le kell állítania |

| 2025. augusztus 2. | GPAI (General-Purpose AI) modellek szabályozása + AI-írástudás kötelezettség | AI modell fejlesztők (OpenAI, Google stb.) + minden AI felhasználó |

| 2026. augusztus 2. | Magas kockázatú AI rendszerek teljes körű szabályozása + bírságolási lehetőség | Minden vállalkozás, amely magas kockázatú AI-t fejleszt vagy használ |

| 2027. augusztus 2. | Magas kockázatú AI rendszerek az I. melléklet szerint (meglévő EU jogszabályok alá eső termékek) | Gyártók, importőrök, forgalmazók |

Fontos: Az AI-írástudás (AI literacy) kötelezettség már 2025 augusztusától él — ez azt jelenti, hogy minden vállalkozásnak, amely AI rendszert használ, biztosítania kell, hogy a munkatársai megfelelő szintű AI-ismeretekkel rendelkezzenek. Ez nem opcionális, hanem a rendelet 4. cikkének kötelező előírása.

Milyen bírságokra számíthatnak a magyar vállalkozások?

Az AmCham Magyarország (2026) szerint a magyar szabályozás az EU AI Act bírságösszegeit alkalmazza, amelyek a jogsértés súlyosságától függnek:

| Jogsértés típusa | Maximális bírság | Forintban (~) |

|---|---|---|

| Tiltott AI gyakorlat használata | 35 millió EUR vagy éves árbevétel 7%-a | ~12,5 milliárd Ft |

| Magas kockázatú AI rendszer nem megfelelő használata | 15 millió EUR vagy éves árbevétel 3%-a | ~5,3 milliárd Ft |

| Hatóságoknak téves/hiányos adatszolgáltatás | 7,5 millió EUR vagy éves árbevétel 1%-a | ~2,7 milliárd Ft |

KKV-knak és startupoknak kedvezőbb feltételek: A rendelet arányos bírságolást ír elő — a kis- és középvállalkozások alacsonyabb bírságra számíthatnak. Ennek ellenére a megfelelés elmaradása reputációs és üzleti kockázatot is jelent, különösen a B2B piacon, ahol a nagyvállalati partnerek egyre gyakrabban követelik meg az AI compliance igazolását.

Ki felügyeli a szabályozást Magyarországon?

Magyarországon az NMHH (Nemzeti Média- és Hírközlési Hatóság) lett kijelölve az EU AI Act végrehajtásáért felelős nemzeti hatóságnak. Az Piac és Profit (2026) beszámolója szerint az NMHH már megkezdte az MI-rendszerek ellenőrzését.

Az NMHH feladatai:

- Regisztráció és nyilvántartás: Magas kockázatú AI rendszerek EU-szintű nyilvántartásba vétele

- Piacfelügyelet: AI rendszerek megfelelőségének ellenőrzése

- Szankciók kiszabása: Bírságok és egyéb intézkedések a jogsértők ellen

- Panaszkezelés: Állampolgári és vállalkozói bejelentések fogadása

A magyar Országgyűlés 2025 novemberében fogadta el az AI Act végrehajtásához szükséges hazai jogszabályokat, amelyek az NMHH hatáskörét és eljárási szabályait részletezik.

Mit kell konkrétan tennie egy magyar vállalkozásnak?

Az AI Act magyar cégeknek szóló útmutatója alapján a következő gyakorlati lépéseket javasoljuk:

1. AI audit — Térképezze fel a használt AI rendszereket

Azonosítsa az összes AI eszközt, amelyet a vállalkozás használ: ChatGPT, automatizációs botok, AI agentek, analitikai eszközök, toborzási szoftverek. Minden egyes eszköznél határozza meg a kockázati kategóriát. A SocialPro AI audit szolgáltatása ezt 1-2 hét alatt elvégzi.

2. Kockázati besorolás — Melyik kategóriába esik?

A legtöbb magyar KKV AI használata a korlátozott kockázat kategóriába esik (chatbotok, tartalom generálás). Ha azonban AI-t használ toborzáshoz, hitelértékeléshez vagy biztonsági rendszerekhez, az magas kockázatú besorolást kaphat — és lényegesen szigorúbb követelményeknek kell megfelelnie.

3. AI policy — Készítsen belső szabályzatot

Rövid, de egyértelmű belső AI szabályzat, amely rögzíti: milyen AI eszközöket használ a cég, ki felel azok használatáért, milyen adatokat dolgoz fel az AI, és milyen emberi felügyeleti pontok vannak beépítve.

4. AI-írástudás biztosítása — Képezze a csapatot

Az AI Act 4. cikke előírja, hogy az AI rendszereket működtető személyzet megfelelő szintű AI-ismeretekkel rendelkezzen. Ez nem jelenti azt, hogy mindenkinek programozónak kell lennie — de tudnia kell, hogyan működik az AI, milyen korlátai vannak, és mikor kell emberi beavatkozást kérni.

5. Átláthatóság biztosítása

Ha chatbotot vagy AI agentet használ ügyfélkommunikációban, kötelező jelezni, hogy az ügyfél AI-val kommunikál. Ha AI-val generál tartalmat (képek, szövegek), azt is jelölni kell. Ez a „korlátozott kockázat" kategória fő követelménye.

6. Dokumentáció és nyilvántartás

Vezessen nyilvántartást a használt AI rendszerekről: milyen modelleket használ, milyen célra, milyen adatokon, és milyen eredményekkel. Magas kockázatú rendszereknél ez részletes technikai dokumentációt jelent.

Nem biztos benne, hogy érintett-e a cége? Töltse ki 2 perces ingyenes kockázatfelmérésünket →

Hogyan érinti az AI Act a különböző iparágakat?

| Iparág | Tipikus AI használat | Kockázati besorolás | Fő kötelezettség |

|---|---|---|---|

| HR / Toborzás | CV szűrés, jelölt rangsorolás | Magas kockázat | Conformity assessment, bias audit, emberi felügyelet |

| Pénzügy | Hitelképesség-értékelés, fraud detection | Magas kockázat | Kockázatkezelési rendszer, dokumentáció, auditálhatóság |

| Ügyfélszolgálat | Chatbot, AI agent | Korlátozott kockázat | Átláthatóság — jelezni kell az AI használatát |

| Marketing | Tartalom generálás, képgenerálás | Korlátozott kockázat | AI-generált tartalom jelölése |

| E-commerce | Ajánlórendszer, ároptimalizálás | Minimális kockázat | Nincs kötelező — önkéntes magatartási kódex ajánlott |

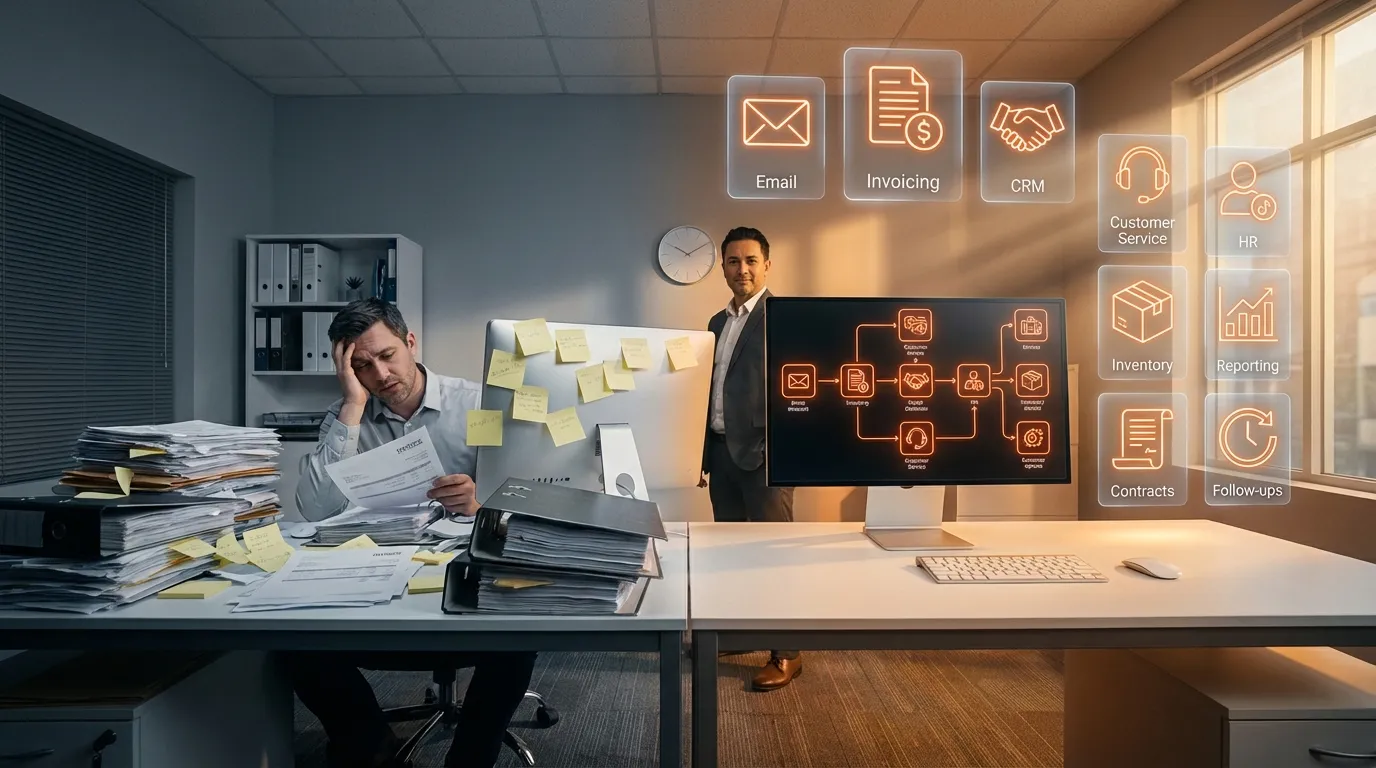

| Üzleti automatizáció | Workflow automatizáció, adatfeldolgozás | Minimális-korlátozott | Adatminőség biztosítása, AI policy |

A Magyar Kereskedelmi és Iparkamara (2025) felhívja a figyelmet, hogy a szabályozás nem csak a technológiai cégekre vonatkozik — minden vállalkozás érintett, amely bármilyen AI eszközt használ a működéséhez.

Mi a helyzet a generatív AI-val és a GPAI modellekkel?

A rendelet külön szabályozza az általános célú AI (GPAI) modelleket — ezek az olyan nagy nyelvi modellek, mint a GPT-4, Claude, Gemini vagy Mistral. A GPAI szolgáltatókat (OpenAI, Anthropic, Google stb.) a következők kötelezik:

- Technikai dokumentáció és használati útmutató biztosítása

- Szerzői jogi megfelelés — a Copyright Directive betartása

- Tréning adatok összefoglalója — nyilvánosan közzé kell tenni, milyen adatokon tanították a modellt

- Szisztémikus kockázatú modellek: Ha a modell rendszerszintű kockázatot jelent (pl. nagy hatású, széles körben használt), további kötelezettségek — modell-értékelés, adversarial tesztelés, incidensjelentés

Ez a magyar vállalkozásokat közvetetten érinti: ha OpenAI-t, Claude-ot vagy Gemini-t használsz, a GPAI szabályozás a szolgáltatóra vonatkozik, nem rád. Viszont ha ezekre építesz egyedi AI agentet, akkor deployer-ként a te felelősséged az átláthatóság és a megfelelő használat biztosítása.

Milyen lehetőségeket teremt az AI Act a magyar vállalkozásoknak?

A szabályozás nem csak teher — üzleti lehetőség is. A Török Balázs (2026) elemzése kiemeli:

- B2B versenyelőny: A nagyvállalati partnerek egyre inkább megkövetelik a beszállítóiktól az AI compliance igazolását. Aki korán megfelel, az előnybe kerül a tender-versenyekben.

- Bizalomépítés: Az átlátható AI használat növeli az ügyfelek bizalmát — a PwC (2025) szerint a fogyasztók 78%-a fontosnak tartja az átlátható AI használatot.

- AI audit szolgáltatás: A magyar piacon kevés cég kínál AI compliance auditot — ez egy növekvő szolgáltatási terület.

- Pályázati lehetőségek: Az AI governance és compliance fejlesztések több pályázati keretből is támogathatóak — a DIMOP Plusz akár 90%-os támogatást biztosít digitális fejlesztésekre.

Hogyan segít a SocialPro az EU AI Act megfelelésben?

A SocialPro AI Governance és Biztonság szolgáltatása négy lépésben segíti a magyar vállalkozásokat:

- AI Audit (1-2 hét): Feltérképezzük az összes használt AI rendszert, kockázati besorolást végzünk, és azonosítjuk a megfelelési hiányosságokat.

- Compliance terv (1 hét): Személyre szabott cselekvési terv a szükséges lépésekkel, határidőkkel és felelősökkel.

- Implementáció (2-4 hét): AI policy kidolgozása, dokumentáció elkészítése, átláthatósági mechanizmusok beépítése, munkatársi képzés.

- Folyamatos monitorozás: Negyedéves felülvizsgálat, szabályozási változások követése, frissítések.

Az AI governance költsége 500.000–1.500.000 Ft egy KKV számára — ami töredéke a potenciális bírságnak.

Gyakran ismételt kérdések az EU AI Act-ról

Rám is vonatkozik az AI Act, ha csak ChatGPT-t használok?

Igen, de csak korlátozottan. A ChatGPT korlátozott kockázatú AI — az átláthatósági kötelezettségnek kell megfelelned (jelezni, ha AI-val generálsz tartalmat), és biztosítanod kell a munkatársaid AI-írástudását. Nem kell conformity assessment-et végezned.

Mikor kezdődjön a felkészülés?

Most. A tiltott gyakorlatokra vonatkozó szabályok már 2025 februárja óta élnek, az AI-írástudás követelmény 2025 augusztusa óta. A magas kockázatú rendszerek teljes szabályozása 2026 augusztusában lép életbe. A felkészülés tipikusan 3-6 hónapot vesz igénybe.

Mi történik, ha nem felelek meg az AI Act-nak?

A jogsértés bírsága akár 35 millió EUR (12,5 milliárd Ft) is lehet. De a pénzügyi kockázaton túl a reputációs kár és az üzleti kapcsolatok elvesztése is fenyeget — a nagyvállalati partnerek egyre gyakrabban kötik szerződéses feltételhez az AI compliance-t.

Kell-e AI-felelős személy a cégben?

A rendelet nem írja elő kifejezetten a „Chief AI Officer" pozíciót, de a magas kockázatú rendszereknél kötelező az emberi felügyelet kijelölése. KKV-knál ez lehet a vezető vagy egy kijelölt munkatárs, aki felel az AI rendszerek megfelelő használatáért.

Hogyan kell jelölni az AI által generált tartalmat?

Az EU AI Act és az ehhez kapcsolódó EU Gyakorlati Kódex szerint az AI által generált tartalmat (szöveg, kép, hang, videó) egyértelműen jelölni kell. Ez történhet felirattal, vízjellel vagy metaadatokkal. A deepfake tartalmak esetében a jelölés kötelező.

Mi a különbség a fejlesztő és a felhasználó kötelezettségei között?

A rendelet különbséget tesz a provider (fejlesztő/szolgáltató) és a deployer (felhasználó/üzemeltető) között. Ha egy magyar cég a SocialPro-val fejlesztet AI agentet, a SocialPro a provider, a megrendelő a deployer. Mindkét félnek vannak kötelezettségei, de a provider felelőssége a termék megfelelősége, a deployer felelőssége a megfelelő használat és az átláthatóság biztosítása.